Kubernetes 文档这一部分包含的一些页面展示如何去完成单个任务。 每个任务页面是一般通过给出若干步骤展示如何执行完成某事。

如果你希望编写一个任务页面,参考 创建一个文档拉取请求。

Kubernetes 文档这一部分包含的一些页面展示如何去完成单个任务。 每个任务页面是一般通过给出若干步骤展示如何执行完成某事。

如果你希望编写一个任务页面,参考 创建一个文档拉取请求。

Kubernetes 命令行工具,kubectl,使得你可以对 Kubernetes 集群运行命令。 你可以使用 kubectl 来部署应用、监测和管理集群资源以及查看日志。

有关更多信息,包括 kubectl 操作的完整列表,请参见kubectl

参考文件。

kubectl 可安装在各种 Linux 平台、 macOS 和 Windows 上。 在下面找到你喜欢的操作系统。

kind 让你能够在本地计算机上运行 Kubernetes。

kind 要求你安装并配置好 Docker。

kind 快速入门页面展示了

开始使用 kind 所需要完成的操作。

与 kind 类似,minikube 是一个工具,

能让你在本地运行 Kubernetes。

minikube 在你本地的个人计算机(包括 Windows、macOS 和 Linux PC)运行一个单节点的

Kubernetes 集群,以便你来尝试 Kubernetes 或者开展每天的开发工作。

如果你关注如何安装此工具,可以按官方的 Get Started!指南操作。

当你拥有了可工作的 minikube 时,就可以用它来

运行示例应用了。

你可以使用 kubeadm 工具来 创建和管理 Kubernetes 集群。 该工具能够执行必要的动作并用一种用户友好的方式启动一个可用的、安全的集群。

安装 kubeadm 展示了如何安装 kubeadm 的过程。 一旦安装了 kubeadm,你就可以使用它来 创建一个集群。

kubectl 版本和集群版本之间的差异必须在一个小版本号内。 例如:v1.23 版本的客户端能与 v1.22、 v1.23 和 v1.24 版本的控制面通信。 用最新兼容版的 kubectl 有助于避免不可预见的问题。

在 Linux 系统中安装 kubectl 有如下几种方法:

用以下命令下载最新发行版:

curl -LO "https://dl.k8s.io/release/$(curl -L -s https://dl.k8s.io/release/stable.txt)/bin/linux/amd64/kubectl"

如需下载某个指定的版本,请用指定版本号替换该命令的这一部分:

$(curl -L -s https://dl.k8s.io/release/stable.txt)。

例如,要在 Linux 中下载 v1.23.0 版本,请输入:

curl -LO https://dl.k8s.io/release/v1.23.0/bin/linux/amd64/kubectl

验证该可执行文件(可选步骤)

下载 kubectl 校验和文件:

curl -LO "https://dl.k8s.io/$(curl -L -s https://dl.k8s.io/release/stable.txt)/bin/linux/amd64/kubectl.sha256"

基于校验和文件,验证 kubectl 的可执行文件:

echo "$(cat kubectl.sha256) kubectl" | sha256sum --check

验证通过时,输出为:

kubectl: OK

验证失败时,sha256 将以非零值退出,并打印如下输出:

kubectl: FAILED

sha256sum: WARNING: 1 computed checksum did NOT match

下载的 kubectl 与校验和文件版本必须相同。

安装 kubectl

sudo install -o root -g root -m 0755 kubectl /usr/local/bin/kubectl

即使你没有目标系统的 root 权限,仍然可以将 kubectl 安装到目录 ~/.local/bin 中:

chmod +x kubectl

mkdir -p ~/.local/bin

mv ./kubectl ~/.local/bin/kubectl

# 之后将 ~/.local/bin 附加(或前置)到 $PATH

执行测试,以保障你安装的版本是最新的:

kubectl version --client

或者使用如下命令来查看版本的详细信息:

kubectl version --client --output=yaml

更新 apt 包索引,并安装使用 Kubernetes apt 仓库所需要的包:

sudo apt-get update

sudo apt-get install -y apt-transport-https ca-certificates curl

下载 Google Cloud 公开签名秘钥:

sudo curl -fsSLo /usr/share/keyrings/kubernetes-archive-keyring.gpg https://packages.cloud.google.com/apt/doc/apt-key.gpg

添加 Kubernetes apt 仓库:

echo "deb [signed-by=/usr/share/keyrings/kubernetes-archive-keyring.gpg] https://apt.kubernetes.io/ kubernetes-xenial main" | sudo tee /etc/apt/sources.list.d/kubernetes.list

更新 apt 包索引,使之包含新的仓库并安装 kubectl:

sudo apt-get update

sudo apt-get install -y kubectl

cat <<EOF | sudo tee /etc/yum.repos.d/kubernetes.repo

[kubernetes]

name=Kubernetes

baseurl=https://packages.cloud.google.com/yum/repos/kubernetes-el7-x86_64

enabled=1

gpgcheck=1

repo_gpgcheck=1

gpgkey=https://packages.cloud.google.com/yum/doc/yum-key.gpg https://packages.cloud.google.com/yum/doc/rpm-package-key.gpg

EOF

sudo yum install -y kubectl

为了让 kubectl 能发现并访问 Kubernetes 集群,你需要一个

kubeconfig 文件,

该文件在

kube-up.sh

创建集群时,或成功部署一个 Miniube 集群时,均会自动生成。

通常,kubectl 的配置信息存放于文件 ~/.kube/config 中。

通过获取集群状态的方法,检查是否已恰当的配置了 kubectl:

kubectl cluster-info

如果返回一个 URL,则意味着 kubectl 成功的访问到了你的集群。

如果你看到如下所示的消息,则代表 kubectl 配置出了问题,或无法连接到 Kubernetes 集群。

The connection to the server <server-name:port> was refused - did you specify the right host or port?

(访问 <server-name:port> 被拒绝 - 你指定的主机和端口是否有误?)

例如,如果你想在自己的笔记本上(本地)运行 Kubernetes 集群,你需要先安装一个 Minikube 这样的工具,然后再重新运行上面的命令。

如果命令 kubectl cluster-info 返回了 url,但你还不能访问集群,那可以用以下命令来检查配置是否妥当:

kubectl cluster-info dump

kubectl 为 Bash、Zsh、Fish 和 PowerShell 提供自动补全功能,可以为你节省大量的输入。

下面是为 Bash、Fish 和 Zsh 设置自动补全功能的操作步骤。

kubectl 的 Bash 补全脚本可以用命令 kubectl completion bash 生成。

在 shell 中导入(Sourcing)补全脚本,将启用 kubectl 自动补全功能。

然而,补全脚本依赖于工具 bash-completion,

所以要先安装它(可以用命令 type _init_completion 检查 bash-completion 是否已安装)。

很多包管理工具均支持 bash-completion(参见这里)。

可以通过 apt-get install bash-completion 或 yum install bash-completion 等命令来安装它。

上述命令将创建文件 /usr/share/bash-completion/bash_completion,它是 bash-completion 的主脚本。

依据包管理工具的实际情况,你需要在 ~/.bashrc 文件中手工导入此文件。

要查看结果,请重新加载你的 shell,并运行命令 type _init_completion。

如果命令执行成功,则设置完成,否则将下面内容添加到文件 ~/.bashrc 中:

source /usr/share/bash-completion/bash_completion

重新加载 shell,再输入命令 type _init_completion 来验证 bash-completion 的安装状态。

你现在需要确保一点:kubectl 补全脚本已经导入(sourced)到 shell 会话中。 可以通过以下两种方法进行设置:

echo 'source <(kubectl completion bash)' >>~/.bashrc

kubectl completion bash | sudo tee /etc/bash_completion.d/kubectl > /dev/null

如果 kubectl 有关联的别名,你可以扩展 shell 补全来适配此别名:

echo 'alias k=kubectl' >>~/.bashrc

echo 'complete -F __start_kubectl k' >>~/.bashrc

bash-completion 负责导入 /etc/bash_completion.d 目录中的所有补全脚本。

两种方式的效果相同。重新加载 shell 后,kubectl 自动补全功能即可生效。

kubectl 通过命令 kubectl completion fish 生成 Fish 自动补全脚本。

在 shell 中导入(Sourcing)该自动补全脚本,将启动 kubectl 自动补全功能。

为了在所有的 shell 会话中实现此功能,请将下面内容加入到文件 ~/.config/fish/config.fish 中。

kubectl completion fish | source

重新加载 shell 后,kubectl 自动补全功能将立即生效。

kubectl 通过命令 kubectl completion zsh 生成 Zsh 自动补全脚本。

在 shell 中导入(Sourcing)该自动补全脚本,将启动 kubectl 自动补全功能。

为了在所有的 shell 会话中实现此功能,请将下面内容加入到文件 ~/.zshrc 中。

source <(kubectl completion zsh)

如果你为 kubectl 定义了别名,kubectl 自动补全将自动使用它。

重新加载 shell 后,kubectl 自动补全功能将立即生效。

如果你收到 2: command not found: compdef 这样的错误提示,那请将下面内容添加到 ~/.zshrc 文件的开头:

autoload -Uz compinit

compinit

kubectl convert 插件一个 Kubernetes 命令行工具 kubectl 的插件,允许你将清单在不同 API 版本间转换。

这对于将清单迁移到新的 Kubernetes 发行版上未被废弃的 API 版本时尤其有帮助。

更多信息请访问 迁移到非弃用 API

用以下命令下载最新发行版:

curl -LO "https://dl.k8s.io/release/$(curl -L -s https://dl.k8s.io/release/stable.txt)/bin/linux/amd64/kubectl-convert"

验证该可执行文件(可选步骤)

下载 kubectl-convert 校验和文件:

curl -LO "https://dl.k8s.io/$(curl -L -s https://dl.k8s.io/release/stable.txt)/bin/linux/amd64/kubectl-convert.sha256"

基于校验和,验证 kubectl-convert 的可执行文件:

echo "$(cat kubectl-convert.sha256) kubectl-convert" | sha256sum --check

验证通过时,输出为:

kubectl-convert: OK

验证失败时,sha256 将以非零值退出,并打印输出类似于:

kubectl-convert: FAILED

sha256sum: WARNING: 1 computed checksum did NOT match

下载相同版本的可执行文件和校验和。

安装 kubectl-convert

sudo install -o root -g root -m 0755 kubectl-convert /usr/local/bin/kubectl-convert

验证插件是否安装成功

kubectl convert --help

如果你没有看到任何错误就代表插件安装成功了。

kubectl 版本和集群之间的差异必须在一个小版本号之内。 例如:v1.23 版本的客户端能与 v1.22、 v1.23 和 v1.24 版本的控制面通信。 用最新兼容版本的 kubectl 有助于避免不可预见的问题。

在 macOS 系统上安装 kubectl 有如下方法:

下载最新的发行版:

curl -LO "https://dl.k8s.io/release/$(curl -L -s https://dl.k8s.io/release/stable.txt)/bin/darwin/amd64/kubectl"

curl -LO "https://dl.k8s.io/release/$(curl -L -s https://dl.k8s.io/release/stable.txt)/bin/darwin/arm64/kubectl"

如果需要下载某个指定的版本,用该指定版本号替换掉命令的这个部分:$(curl -L -s https://dl.k8s.io/release/stable.txt)。

例如:要为 Intel macOS 系统下载 v1.23.0 版本,则输入:

curl -LO "https://dl.k8s.io/release/v1.23.0/bin/darwin/amd64/kubectl"

对于 Apple Silicon 版本的 macOS,输入:

curl -LO "https://dl.k8s.io/release/v1.23.0/bin/darwin/arm64/kubectl"

验证可执行文件(可选操作)

下载 kubectl 的校验和文件:

curl -LO "https://dl.k8s.io/release/$(curl -L -s https://dl.k8s.io/release/stable.txt)/bin/darwin/amd64/kubectl.sha256"

curl -LO "https://dl.k8s.io/release/$(curl -L -s https://dl.k8s.io/release/stable.txt)/bin/darwin/arm64/kubectl.sha256"

根据校验和文件,验证 kubectl:

echo "$(cat kubectl.sha256) kubectl" | shasum -a 256 --check

验证通过时,输出如下:

kubectl: OK

验证失败时,shasum 将以非零值退出,并打印如下输出:

kubectl: FAILED

shasum: WARNING: 1 computed checksum did NOT match

下载的 kubectl 与校验和文件版本要相同。

将 kubectl 置为可执行文件:

chmod +x ./kubectl

将可执行文件 kubectl 移动到系统可寻址路径 PATH 内的一个位置:

sudo mv ./kubectl /usr/local/bin/kubectl

sudo chown root: /usr/local/bin/kubectl

确保 /usr/local/bin 在你的 PATH 环境变量中。

测试一下,确保你安装的是最新的版本:

kubectl version --client

或者使用下面命令来查看版本的详细信息:

kubectl version --client --output=yaml

如果你是 macOS 系统,且用的是 Homebrew 包管理工具, 则可以用 Homebrew 安装 kubectl。

运行安装命令:

brew install kubectl

或

brew install kubernetes-cli

测试一下,确保你安装的是最新的版本:

kubectl version --client

如果你用的是 macOS,且用 Macports 包管理工具,则你可以用 Macports 安装kubectl。

运行安装命令:

sudo port selfupdate

sudo port install kubectl

测试一下,确保你安装的是最新的版本:

kubectl version --client

为了让 kubectl 能发现并访问 Kubernetes 集群,你需要一个

kubeconfig 文件,

该文件在

kube-up.sh

创建集群时,或成功部署一个 Miniube 集群时,均会自动生成。

通常,kubectl 的配置信息存放于文件 ~/.kube/config 中。

通过获取集群状态的方法,检查是否已恰当的配置了 kubectl:

kubectl cluster-info

如果返回一个 URL,则意味着 kubectl 成功的访问到了你的集群。

如果你看到如下所示的消息,则代表 kubectl 配置出了问题,或无法连接到 Kubernetes 集群。

The connection to the server <server-name:port> was refused - did you specify the right host or port?

(访问 <server-name:port> 被拒绝 - 你指定的主机和端口是否有误?)

例如,如果你想在自己的笔记本上(本地)运行 Kubernetes 集群,你需要先安装一个 Minikube 这样的工具,然后再重新运行上面的命令。

如果命令 kubectl cluster-info 返回了 url,但你还不能访问集群,那可以用以下命令来检查配置是否妥当:

kubectl cluster-info dump

kubectl 为 Bash、Zsh、Fish 和 PowerShell 提供自动补全功能,可以为你节省大量的输入。

下面是为 Bash、Fish 和 Zsh 设置自动补全功能的操作步骤。

kubectl 的 Bash 补全脚本可以通过 kubectl completion bash 命令生成。

在你的 shell 中导入(Sourcing)这个脚本即可启用补全功能。

此外,kubectl 补全脚本依赖于工具 bash-completion, 所以你必须先安装它。

bash-completion 有两个版本:v1 和 v2。v1 对应 Bash3.2(也是 macOS 的默认安装版本),v2 对应 Bash 4.1+。 kubectl 的补全脚本无法适配 bash-completion v1 和 Bash 3.2。 必须为它配备 bash-completion v2 和 Bash 4.1+。 有鉴于此,为了在 macOS 上使用 kubectl 补全功能,你必须要安装和使用 Bash 4.1+ (说明)。 后续说明假定你用的是 Bash 4.1+(也就是 Bash 4.1 或更新的版本)

后续说明假定你已使用 Bash 4.1+。你可以运行以下命令检查 Bash 版本:

echo $BASH_VERSION

如果版本太旧,可以用 Homebrew 安装/升级:

brew install bash

重新加载 shell,并验证所需的版本已经生效:

echo $BASH_VERSION $SHELL

Homebrew 通常把它安装为 /usr/local/bin/bash。

如前所述,本说明假定你使用的 Bash 版本为 4.1+,这意味着你要安装 bash-completion v2 (不同于 Bash 3.2 和 bash-completion v1,kubectl 的补全功能在该场景下无法工作)。

你可以用命令 type _init_completion 测试 bash-completion v2 是否已经安装。

如未安装,用 Homebrew 来安装它:

brew install bash-completion@2

如命令的输出信息所显示的,将如下内容添加到文件 ~/.bash_profile 中:

export BASH_COMPLETION_COMPAT_DIR="/usr/local/etc/bash_completion.d"

[[ -r "/usr/local/etc/profile.d/bash_completion.sh" ]] && . "/usr/local/etc/profile.d/bash_completion.sh"

重新加载 shell,并用命令 type _init_completion 验证 bash-completion v2 已经恰当的安装。

你现在需要确保在所有的 shell 环境中均已导入(sourced) kubectl 的补全脚本, 有若干种方法可以实现这一点:

在文件 ~/.bash_profile 中导入(Source)补全脚本:

echo 'source <(kubectl completion bash)' >>~/.bash_profile

将补全脚本添加到目录 /usr/local/etc/bash_completion.d 中:

kubectl completion bash >/usr/local/etc/bash_completion.d/kubectl

如果你为 kubectl 定义了别名,则可以扩展 shell 补全来兼容该别名:

echo 'alias k=kubectl' >>~/.bash_profile

echo 'complete -F __start_kubectl k' >>~/.bash_profile

如果你是用 Homebrew 安装的 kubectl(如

此页面

所描述),则kubectl 补全脚本应该已经安装到目录 /usr/local/etc/bash_completion.d/kubectl

中了。这种情况下,你什么都不需要做。

用 Hommbrew 安装的 bash-completion v2 会初始化 目录 BASH_COMPLETION_COMPAT_DIR

中的所有文件,这就是后两种方法能正常工作的原因。

总之,重新加载 shell 之后,kubectl 补全功能将立即生效。

kubectl 通过命令 kubectl completion fish 生成 Fish 自动补全脚本。

在 shell 中导入(Sourcing)该自动补全脚本,将启动 kubectl 自动补全功能。

为了在所有的 shell 会话中实现此功能,请将下面内容加入到文件 ~/.config/fish/config.fish 中。

kubectl completion fish | source

重新加载 shell 后,kubectl 自动补全功能将立即生效。

kubectl 通过命令 kubectl completion zsh 生成 Zsh 自动补全脚本。

在 shell 中导入(Sourcing)该自动补全脚本,将启动 kubectl 自动补全功能。

为了在所有的 shell 会话中实现此功能,请将下面内容加入到文件 ~/.zshrc 中。

source <(kubectl completion zsh)

如果你为 kubectl 定义了别名,kubectl 自动补全将自动使用它。

重新加载 shell 后,kubectl 自动补全功能将立即生效。

如果你收到 2: command not found: compdef 这样的错误提示,那请将下面内容添加到 ~/.zshrc 文件的开头:

autoload -Uz compinit

compinit

kubectl convert 插件一个 Kubernetes 命令行工具 kubectl 的插件,允许你将清单在不同 API 版本间转换。

这对于将清单迁移到新的 Kubernetes 发行版上未被废弃的 API 版本时尤其有帮助。

更多信息请访问 迁移到非弃用 API

用以下命令下载最新发行版:

curl -LO "https://dl.k8s.io/release/$(curl -L -s https://dl.k8s.io/release/stable.txt)/bin/darwin/amd64/kubectl-convert"

curl -LO "https://dl.k8s.io/release/$(curl -L -s https://dl.k8s.io/release/stable.txt)/bin/darwin/arm64/kubectl-convert"

验证该可执行文件(可选步骤)

下载 kubectl-convert 校验和文件:

curl -LO "https://dl.k8s.io/release/$(curl -L -s https://dl.k8s.io/release/stable.txt)/bin/darwin/amd64/kubectl-convert.sha256"

curl -LO "https://dl.k8s.io/release/$(curl -L -s https://dl.k8s.io/release/stable.txt)/bin/darwin/arm64/kubectl-convert.sha256"

基于校验和,验证 kubectl-convert 的可执行文件:

echo "$(cat kubectl-convert.sha256) kubectl-convert" | shasum -a 256 --check

验证通过时,输出为:

kubectl-convert: OK

验证失败时,sha256 将以非零值退出,并打印输出类似于:

kubectl-convert: FAILED

shasum: WARNING: 1 computed checksum did NOT match

下载相同版本的可执行文件和校验和。

使 kubectl-convert 二进制文件可执行

chmod +x ./kubectl-convert

将 kubectl-convert 可执行文件移动到系统 PATH 环境变量中的一个位置。

sudo mv ./kubectl-convert /usr/local/bin/kubectl-convert

sudo chown root: /usr/local/bin/kubectl-convert

确保你的 PATH 环境变量中存在 /usr/local/bin

验证插件是否安装成功

kubectl convert --help

如果你没有看到任何错误就代表插件安装成功了。

kubectl 版本和集群版本之间的差异必须在一个小版本号内。 例如:v1.23 版本的客户端能与 v1.22、 v1.23 和 v1.24 版本的控制面通信。 用最新兼容版的 kubectl 有助于避免不可预见的问题。

在 Windows 系统中安装 kubectl 有如下几种方法:

下载 最新发行版 v1.23.0。

如果你已安装了 curl,也可以使用此命令:

curl -LO "https://dl.k8s.io/release/v1.23.0/bin/windows/amd64/kubectl.exe"

验证该可执行文件(可选步骤)

下载 kubectl 校验和文件:

curl -LO "https://dl.k8s.io/v1.23.0/bin/windows/amd64/kubectl.exe.sha256"

基于校验和文件,验证 kubectl 的可执行文件:

在命令行环境中,手工对比 CertUtil 命令的输出与校验和文件:

CertUtil -hashfile kubectl.exe SHA256

type kubectl.exe.sha256

用 PowerShell 自动验证,用运算符 -eq 来直接取得 True 或 False 的结果:

$($(CertUtil -hashfile .\kubectl.exe SHA256)[1] -replace " ", "") -eq $(type .\kubectl.exe.sha256)

将 kubectl 二进制文件夹追加或插入到你的 PATH 环境变量中。

测试一下,确保此 kubectl 的版本和期望版本一致:

kubectl version --client

或者使用下面命令来查看版本的详细信息:

kubectl version --client --output=yaml

kubectl 添加到 PATH。

如果你之前安装过 Docker Desktop,可能需要把此 PATH 条目置于 Docker Desktop 安装的条目之前,

或者直接删掉 Docker Desktop 的 kubectl。

要在 Windows 上安装 kubectl,你可以使用包管理器 Chocolatey 或是命令行安装器 Scoop。

choco install kubernetes-cli

scoop install kubectl

测试一下,确保安装的是最新版本:

kubectl version --client

导航到你的 home 目录:

# 当你用 cmd.exe 时,则运行: cd %USERPROFILE%

cd ~

创建目录 .kube:

mkdir .kube

切换到新创建的目录 .kube

cd .kube

配置 kubectl,以接入远程的 Kubernetes 集群:

New-Item config -type file

为了让 kubectl 能发现并访问 Kubernetes 集群,你需要一个

kubeconfig 文件,

该文件在

kube-up.sh

创建集群时,或成功部署一个 Miniube 集群时,均会自动生成。

通常,kubectl 的配置信息存放于文件 ~/.kube/config 中。

通过获取集群状态的方法,检查是否已恰当的配置了 kubectl:

kubectl cluster-info

如果返回一个 URL,则意味着 kubectl 成功的访问到了你的集群。

如果你看到如下所示的消息,则代表 kubectl 配置出了问题,或无法连接到 Kubernetes 集群。

The connection to the server <server-name:port> was refused - did you specify the right host or port?

(访问 <server-name:port> 被拒绝 - 你指定的主机和端口是否有误?)

例如,如果你想在自己的笔记本上(本地)运行 Kubernetes 集群,你需要先安装一个 Minikube 这样的工具,然后再重新运行上面的命令。

如果命令 kubectl cluster-info 返回了 url,但你还不能访问集群,那可以用以下命令来检查配置是否妥当:

kubectl cluster-info dump

kubectl 为 Bash、Zsh、Fish 和 PowerShell 提供自动补全功能,可以为你节省大量的输入。

下面是设置 PowerShell 自动补全功能的操作步骤。

使用命令 kubectl completion powershell 生成 PowerShell 的 kubectl 自动补全脚本。

如果需要自动补全在所有 shell 会话中生效,请将以下命令添加到 $PROFILE 文件中:

kubectl completion powershell | Out-String | Invoke-Expression

此命令将在每次 PowerShell 启动时重新生成自动补全脚本。你还可以将生成的自动补全脚本添加到 $PROFILE 文件中。

如果需要将自动补全脚本直接添加到 $PROFILE 文件中,请在 PowerShell 终端运行以下命令:

kubectl completion powershell >> $PROFILE

完成上述操作后重启 shell,kubectl的自动补全就可以工作了。

kubectl convert 插件一个 Kubernetes 命令行工具 kubectl 的插件,允许你将清单在不同 API 版本间转换。

这对于将清单迁移到新的 Kubernetes 发行版上未被废弃的 API 版本时尤其有帮助。

更多信息请访问 迁移到非弃用 API

用以下命令下载最新发行版:

curl -LO "https://dl.k8s.io/release/v1.23.0/bin/windows/amd64/kubectl-convert.exe"

验证该可执行文件(可选步骤)

下载 kubectl-convert 校验和文件:

curl -LO "https://dl.k8s.io/v1.23.0/bin/windows/amd64/kubectl-convert.exe.sha256"

基于校验和,验证 kubectl-convert 的可执行文件:

用提示的命令对 CertUtil 的输出和下载的校验和文件进行手动比较。

CertUtil -hashfile kubectl-convert.exe SHA256

type kubectl-convert.exe.sha256

使用 PowerShell -eq 操作使验证自动化,获得 True 或者 False 的结果:

$($(CertUtil -hashfile .\kubectl-convert.exe SHA256)[1] -replace " ", "") -eq $(type .\kubectl-convert.exe.sha256)

将 kubectl-convert 二进制文件夹附加或添加到你的 PATH 环境变量中。

验证插件是否安装成功

kubectl convert --help

如果你没有看到任何错误就代表插件安装成功了。

kubectl 通过命令 kubectl completion fish 生成 Fish 自动补全脚本。

在 shell 中导入(Sourcing)该自动补全脚本,将启动 kubectl 自动补全功能。

为了在所有的 shell 会话中实现此功能,请将下面内容加入到文件 ~/.config/fish/config.fish 中。

kubectl completion fish | source

重新加载 shell 后,kubectl 自动补全功能将立即生效。

一个 Kubernetes 命令行工具 kubectl 的插件,允许你将清单在不同 API 版本间转换。

这对于将清单迁移到新的 Kubernetes 发行版上未被废弃的 API 版本时尤其有帮助。

更多信息请访问 迁移到非弃用 API

kubectl 的 Bash 补全脚本可以用命令 kubectl completion bash 生成。

在 shell 中导入(Sourcing)补全脚本,将启用 kubectl 自动补全功能。

然而,补全脚本依赖于工具 bash-completion,

所以要先安装它(可以用命令 type _init_completion 检查 bash-completion 是否已安装)。

很多包管理工具均支持 bash-completion(参见这里)。

可以通过 apt-get install bash-completion 或 yum install bash-completion 等命令来安装它。

上述命令将创建文件 /usr/share/bash-completion/bash_completion,它是 bash-completion 的主脚本。

依据包管理工具的实际情况,你需要在 ~/.bashrc 文件中手工导入此文件。

要查看结果,请重新加载你的 shell,并运行命令 type _init_completion。

如果命令执行成功,则设置完成,否则将下面内容添加到文件 ~/.bashrc 中:

source /usr/share/bash-completion/bash_completion

重新加载 shell,再输入命令 type _init_completion 来验证 bash-completion 的安装状态。

你现在需要确保一点:kubectl 补全脚本已经导入(sourced)到 shell 会话中。 可以通过以下两种方法进行设置:

echo 'source <(kubectl completion bash)' >>~/.bashrc

kubectl completion bash | sudo tee /etc/bash_completion.d/kubectl > /dev/null

如果 kubectl 有关联的别名,你可以扩展 shell 补全来适配此别名:

echo 'alias k=kubectl' >>~/.bashrc

echo 'complete -F __start_kubectl k' >>~/.bashrc

bash-completion 负责导入 /etc/bash_completion.d 目录中的所有补全脚本。

两种方式的效果相同。重新加载 shell 后,kubectl 自动补全功能即可生效。

kubectl 的 Bash 补全脚本可以通过 kubectl completion bash 命令生成。

在你的 shell 中导入(Sourcing)这个脚本即可启用补全功能。

此外,kubectl 补全脚本依赖于工具 bash-completion, 所以你必须先安装它。

bash-completion 有两个版本:v1 和 v2。v1 对应 Bash3.2(也是 macOS 的默认安装版本),v2 对应 Bash 4.1+。 kubectl 的补全脚本无法适配 bash-completion v1 和 Bash 3.2。 必须为它配备 bash-completion v2 和 Bash 4.1+。 有鉴于此,为了在 macOS 上使用 kubectl 补全功能,你必须要安装和使用 Bash 4.1+ (说明)。 后续说明假定你用的是 Bash 4.1+(也就是 Bash 4.1 或更新的版本)

后续说明假定你已使用 Bash 4.1+。你可以运行以下命令检查 Bash 版本:

echo $BASH_VERSION

如果版本太旧,可以用 Homebrew 安装/升级:

brew install bash

重新加载 shell,并验证所需的版本已经生效:

echo $BASH_VERSION $SHELL

Homebrew 通常把它安装为 /usr/local/bin/bash。

如前所述,本说明假定你使用的 Bash 版本为 4.1+,这意味着你要安装 bash-completion v2 (不同于 Bash 3.2 和 bash-completion v1,kubectl 的补全功能在该场景下无法工作)。

你可以用命令 type _init_completion 测试 bash-completion v2 是否已经安装。

如未安装,用 Homebrew 来安装它:

brew install bash-completion@2

如命令的输出信息所显示的,将如下内容添加到文件 ~/.bash_profile 中:

export BASH_COMPLETION_COMPAT_DIR="/usr/local/etc/bash_completion.d"

[[ -r "/usr/local/etc/profile.d/bash_completion.sh" ]] && . "/usr/local/etc/profile.d/bash_completion.sh"

重新加载 shell,并用命令 type _init_completion 验证 bash-completion v2 已经恰当的安装。

你现在需要确保在所有的 shell 环境中均已导入(sourced) kubectl 的补全脚本, 有若干种方法可以实现这一点:

在文件 ~/.bash_profile 中导入(Source)补全脚本:

echo 'source <(kubectl completion bash)' >>~/.bash_profile

将补全脚本添加到目录 /usr/local/etc/bash_completion.d 中:

kubectl completion bash >/usr/local/etc/bash_completion.d/kubectl

如果你为 kubectl 定义了别名,则可以扩展 shell 补全来兼容该别名:

echo 'alias k=kubectl' >>~/.bash_profile

echo 'complete -F __start_kubectl k' >>~/.bash_profile

如果你是用 Homebrew 安装的 kubectl(如

此页面

所描述),则kubectl 补全脚本应该已经安装到目录 /usr/local/etc/bash_completion.d/kubectl

中了。这种情况下,你什么都不需要做。

用 Hommbrew 安装的 bash-completion v2 会初始化 目录 BASH_COMPLETION_COMPAT_DIR

中的所有文件,这就是后两种方法能正常工作的原因。

总之,重新加载 shell 之后,kubectl 补全功能将立即生效。

使用命令 kubectl completion powershell 生成 PowerShell 的 kubectl 自动补全脚本。

如果需要自动补全在所有 shell 会话中生效,请将以下命令添加到 $PROFILE 文件中:

kubectl completion powershell | Out-String | Invoke-Expression

此命令将在每次 PowerShell 启动时重新生成自动补全脚本。你还可以将生成的自动补全脚本添加到 $PROFILE 文件中。

如果需要将自动补全脚本直接添加到 $PROFILE 文件中,请在 PowerShell 终端运行以下命令:

kubectl completion powershell >> $PROFILE

完成上述操作后重启 shell,kubectl的自动补全就可以工作了。

kubectl 通过命令 kubectl completion zsh 生成 Zsh 自动补全脚本。

在 shell 中导入(Sourcing)该自动补全脚本,将启动 kubectl 自动补全功能。

为了在所有的 shell 会话中实现此功能,请将下面内容加入到文件 ~/.zshrc 中。

source <(kubectl completion zsh)

如果你为 kubectl 定义了别名,kubectl 自动补全将自动使用它。

重新加载 shell 后,kubectl 自动补全功能将立即生效。

如果你收到 2: command not found: compdef 这样的错误提示,那请将下面内容添加到 ~/.zshrc 文件的开头:

autoload -Uz compinit

compinit

为了让 kubectl 能发现并访问 Kubernetes 集群,你需要一个

kubeconfig 文件,

该文件在

kube-up.sh

创建集群时,或成功部署一个 Miniube 集群时,均会自动生成。

通常,kubectl 的配置信息存放于文件 ~/.kube/config 中。

通过获取集群状态的方法,检查是否已恰当的配置了 kubectl:

kubectl cluster-info

如果返回一个 URL,则意味着 kubectl 成功的访问到了你的集群。

如果你看到如下所示的消息,则代表 kubectl 配置出了问题,或无法连接到 Kubernetes 集群。

The connection to the server <server-name:port> was refused - did you specify the right host or port?

(访问 <server-name:port> 被拒绝 - 你指定的主机和端口是否有误?)

例如,如果你想在自己的笔记本上(本地)运行 Kubernetes 集群,你需要先安装一个 Minikube 这样的工具,然后再重新运行上面的命令。

如果命令 kubectl cluster-info 返回了 url,但你还不能访问集群,那可以用以下命令来检查配置是否妥当:

kubectl cluster-info dump

本节提供从 dockershim 迁移到其他容器运行时的必备知识。

自从 Kubernetes 1.20 宣布 弃用 dockershim, 各类疑问随之而来:这对各类工作负载和 Kubernetes 部署会产生什么影响。 我们的弃用 Dockershim 常见问题可以帮助你更好地理解这个问题。

建议从 dockershim 迁移到其他替代的容器运行时。 请参阅容器运行时 一节以了解可用的备选项。 当在迁移过程中遇到麻烦,请上报问题。 那么问题就可以及时修复,你的集群也可以进入移除 dockershim 前的就绪状态。

本页面描述查明集群中节点所使用的容器运行时 的步骤。

取决于你运行集群的方式,节点所使用的容器运行时可能是事先配置好的,

也可能需要你来配置。如果你在使用托管的 Kubernetes 服务,

可能存在特定于厂商的方法来检查节点上配置的容器运行时。

本页描述的方法应该在能够执行 kubectl 的场合下都可以工作。

安装并配置 kubectl。参见安装工具 节了解详情。

使用 kubectl 来读取并显示节点信息:

kubectl get nodes -o wide

输出如下面所示。CONTAINER-RUNTIME 列给出容器运行时及其版本。

# For dockershim

NAME STATUS VERSION CONTAINER-RUNTIME

node-1 Ready v1.16.15 docker://19.3.1

node-2 Ready v1.16.15 docker://19.3.1

node-3 Ready v1.16.15 docker://19.3.1

# For containerd

NAME STATUS VERSION CONTAINER-RUNTIME

node-1 Ready v1.19.6 containerd://1.4.1

node-2 Ready v1.19.6 containerd://1.4.1

node-3 Ready v1.19.6 containerd://1.4.1

你可以在容器运行时 页面找到与容器运行时相关的更多信息。

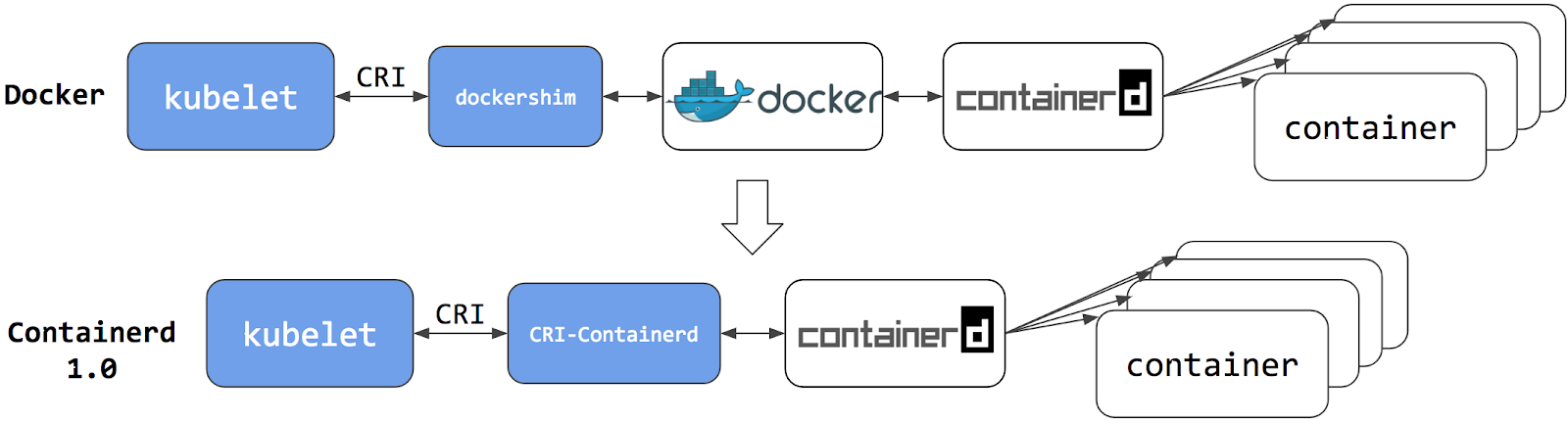

Kubernetes 的 dockershim 组件使得你可以把 Docker 用作 Kubernetes 的

容器运行时。

在 Kubernetes v1.20 版本中,内建组件 dockershim 被弃用。

本页讲解你的集群把 Docker 用作容器运行时的运作机制,

并提供使用 dockershim 时,它所扮演角色的详细信息,

继而展示了一组操作,可用来检查弃用 dockershim 对你的工作负载是否有影响。

即使你是通过 Docker 创建的应用容器,也不妨碍你在其他任何容器运行时上运行这些容器。 这种使用 Docker 的方式并不构成对 Docker 作为一个容器运行时的依赖。

当用了别的容器运行时之后,Docker 命令可能不工作,或者产生意外的输出。 下面是判定你是否依赖于 Docker 的方法。

docker ps)、重新启动 Docker

服务(如 systemctl restart docker.service)或修改 Docker 配置文件

/etc/docker/daemon.json。/etc/docker/daemon.json)中容器镜像仓库的镜像(mirror)站点设置。

这些配置通常需要针对不同容器运行时来重新设置。容器运行时是一个软件,用来运行组成 Kubernetes Pod 的容器。 Kubernetes 负责编排和调度 Pod;在每一个节点上,kubelet 使用抽象的容器运行时接口,所以你可以任意选用兼容的容器运行时。

在早期版本中,Kubernetes 提供的兼容性支持一个容器运行时:Docker。

在 Kubernetes 发展历史中,集群运营人员希望采用更多的容器运行时。

于是 CRI 被设计出来满足这类灵活性需要 - 而 kubelet 亦开始支持 CRI。

然而,因为 Docker 在 CRI 规范创建之前就已经存在,Kubernetes 就创建了一个适配器组件 dockershim。

dockershim 适配器允许 kubelet 与 Docker 交互,就好像 Docker 是一个 CRI 兼容的运行时一样。

你可以阅读博文 Kubernetes 正式支持集成 Containerd。

切换到容器运行时 Containerd 可以消除掉中间环节。 所有相同的容器都可由 Containerd 这类容器运行时来运行。 但是现在,由于直接用容器运行时调度容器,它们对 Docker 是不可见的。 因此,你以前用来检查这些容器的 Docker 工具或漂亮的 UI 都不再可用。

你不能再使用 docker ps 或 docker inspect 命令来获取容器信息。

由于你不能列出容器,因此你不能获取日志、停止容器,甚至不能通过 docker exec 在容器中执行命令。

你仍然可以下载镜像,或者用 docker build 命令创建它们。

但用 Docker 创建、下载的镜像,对于容器运行时和 Kubernetes,均不可见。

为了在 Kubernetes 中使用,需要把镜像推送(push)到某镜像仓库。

在 Kubernetes 1.20 版本中,dockershim 被弃用。 在博文弃用 Dockershim 常见问题中, 你大概已经了解到,大多数应用并没有直接通过运行时来托管容器。 但是,仍然有大量的遥测和安全代理依赖 docker 来收集容器元数据、日志和指标。 本文汇总了一些信息和链接:信息用于阐述如何探查这些依赖,链接用于解释如何迁移这些代理去使用通用的工具或其他容器运行。

为了让代理运行在 Kubernetes 集群中,我们有几种办法。 代理既可以直接在节点上运行,也可以作为守护进程运行。

因为历史原因,Kubernetes 建立在 Docker 之上。 Kubernetes 管理网络和调度,Docker 则在具体的节点上定位并操作容器。 所以,你可以从 Kubernetes 取得调度相关的元数据,比如 Pod 名称;从 Docker 取得容器状态信息。 后来,人们开发了更多的运行时来管理容器。 同时一些项目和 Kubernetes 特性也不断涌现,支持跨多个运行时收集容器状态信息。

一些代理和 Docker 工具紧密绑定。此类代理可以这样运行命令,比如用

docker ps

或 docker top

这类命令来列出容器和进程,用

docker logs

订阅 Docker 的日志。

但随着 Docker 作为容器运行时被弃用,这些命令将不再工作。

如果某 Pod 想调用运行在节点上的 dockerd,该 Pod 必须满足以下两个条件之一:

举例来说:在 COS 镜像中,Docker 通过 /var/run/docker.sock 开放其 Unix 域套接字。

这意味着 Pod 的规约中需要包含 hostPath 卷以挂载 /var/run/docker.sock。

下面是一个 shell 示例脚本,用于查找包含直接映射 Docker 套接字的挂载点的 Pod。

你也可以删掉 grep /var/run/docker.sock 这一代码片段以查看其它挂载信息。

kubectl get pods --all-namespaces \

-o=jsonpath='{range .items[*]}{"\n"}{.metadata.namespace}{":\t"}{.metadata.name}{":\t"}{range .spec.volumes[*]}{.hostPath.path}{", "}{end}{end}' \

| sort \

| grep '/var/run/docker.sock'

/var/run 的父目录而非其完整路径

(就像这个例子)。

上述脚本只检测最常见的使用方式。

在你的集群节点被定制、且在各个节点上均安装了额外的安全和遥测代理的场景下, 一定要和代理的供应商确认:该代理是否依赖于 Docker。

我们通过 谷歌文档 提供了为各类遥测和安全代理供应商准备的持续更新的迁移指导。 请与供应商联系,获取从 dockershim 迁移的最新说明。

title: 将节点上的容器运行时从 Docker Engine 改为 containerd weight: 8 content_type: task

本任务给出将容器运行时从 Docker 改为 containerd 所需的步骤。 此任务适用于运行 1.23 或更早版本 Kubernetes 的集群操作人员。 同时,此任务也涉及从 dockershim 迁移到 containerd 的示例场景, 以及可以从此页面 获得的其他容器运行时列表。

安装 containerd。进一步的信息可参见 containerd 的安装文档。 关于一些特定的环境准备工作,请参阅此页面。

# 将 <node-to-drain> 替换为你所要腾空的节点的名称

kubectl drain <node-to-drain> --ignore-daemonsets

systemctl stop kubelet

systemctl disable docker.service --now

此页面 包含安装 containerd 的详细步骤。

containerd.io 包。关于为你所使用的 Linux 发行版来设置

Docker 仓库,以及安装 containerd.io 包的详细说明,可参见

Install Docker Engine。配置 containerd:

sudo mkdir -p /etc/containerd

containerd config default | sudo tee /etc/containerd/config.toml

重启 containerd:

sudo systemctl restart containerd

启动一个 Powershell 会话,将 $Version 设置为期望的版本(例如:$Version="1.4.3"),

之后运行下面的命令:

下载 containerd:

curl.exe -L https://github.com/containerd/containerd/releases/download/v$Version/containerd-$Version-windows-amd64.tar.gz -o containerd-windows-amd64.tar.gz

tar.exe xvf .\containerd-windows-amd64.tar.gz

解压缩并执行配置:

Copy-Item -Path ".\bin\" -Destination "$Env:ProgramFiles\containerd" -Recurse -Force

cd $Env:ProgramFiles\containerd\

.\containerd.exe config default | Out-File config.toml -Encoding ascii

# 请审查配置信息。取决于你的安装环境,你可能需要调整:

# - the sandbox_image (Kubernetes pause 镜像)

# - cni bin_dir 和 conf_dir 的位置

Get-Content config.toml

# (可选步骤,但强烈建议执行)将 containerd 排除在 Windows Defender 扫描之外

Add-MpPreference -ExclusionProcess "$Env:ProgramFiles\containerd\containerd.exe"

启动 containerd:

.\containerd.exe --register-service

Start-Service containerd

编辑文件 /var/lib/kubelet/kubeadm-flags.env,将 containerd 运行时添加到标志中:

--container-runtime=remote 和 --container-runtime-endpoint=unix:///run/containerd/containerd.sock"。

对于使用 kubeadm 的用户,可以考虑下面的问题:

kubeadm 工具将每个主机的 CRI 套接字保存在该主机对应的 Node 对象的注解中。

要更改这一注解信息,你必须执行下面的操作:

在一台包含 /etc/kubernetes/admin.conf 文件的机器上,执行

kubectl edit no <节点名称>。

这一命令会打开一个文本编辑器,供你在其中编辑 Node 对象。

要选择不同的文本编辑器,你可以设置 KUBE_EDITOR 环境变量。

更改 kubeadm.alpha.kubernetes.io/cri-socket 值,将其从

/var/run/dockershim.sock 改为你所选择的 CRI 套接字路径

(例如:unix:///run/containerd/containerd.sock)。

注意新的 CRI 套接字路径必须带有 unix:// 前缀。

保存文本编辑器中所作的修改,这会更新 Node 对象。

systemctl start kubelet

运行 kubectl get nodes -o wide,containerd 会显示为我们所更改的节点上的运行时。

最后,在一切顺利时删除 Docker。

sudo yum remove docker-ce docker-ce-cli

sudo apt-get purge docker-ce docker-ce-cli

sudo dnf remove docker-ce docker-ce-cli

sudo apt-get purge docker-ce docker-ce-cli

Kubernetes v1.15 [stable]

由 kubeadm 生成的客户端证书在 1 年后到期。 本页说明如何使用 kubeadm 管理证书续订。

你应该熟悉 Kubernetes 中的 PKI 证书和要求。

默认情况下, kubeadm 会生成运行一个集群所需的全部证书。 你可以通过提供你自己的证书来改变这个行为策略。

如果要这样做, 你必须将证书文件放置在通过 --cert-dir 命令行参数或者 kubeadm 配置中的

CertificatesDir 配置项指明的目录中。默认的值是 /etc/kubernetes/pki。

如果在运行 kubeadm init 之前存在给定的证书和私钥对,kubeadm 将不会重写它们。

例如,这意味着您可以将现有的 CA 复制到 /etc/kubernetes/pki/ca.crt 和

/etc/kubernetes/pki/ca.key 中,而 kubeadm 将使用此 CA 对其余证书进行签名。

只提供了 ca.crt 文件但是不提供 ca.key 文件也是可以的

(这只对 CA 根证书可用,其它证书不可用)。

如果所有的其它证书和 kubeconfig 文件已就绪,kubeadm 检测到满足以上条件就会激活

"外部 CA" 模式。kubeadm 将会在没有 CA 密钥文件的情况下继续执行。

否则, kubeadm 将独立运行 controller-manager,附加一个

--controllers=csrsigner 的参数,并且指明 CA 证书和密钥。

PKI 证书和要求包括集群使用外部 CA 的设置指南。

你可以使用 check-expiration 子命令来检查证书何时过期

kubeadm certs check-expiration

输出类似于以下内容:

CERTIFICATE EXPIRES RESIDUAL TIME CERTIFICATE AUTHORITY EXTERNALLY MANAGED

admin.conf Dec 30, 2020 23:36 UTC 364d no

apiserver Dec 30, 2020 23:36 UTC 364d ca no

apiserver-etcd-client Dec 30, 2020 23:36 UTC 364d etcd-ca no

apiserver-kubelet-client Dec 30, 2020 23:36 UTC 364d ca no

controller-manager.conf Dec 30, 2020 23:36 UTC 364d no

etcd-healthcheck-client Dec 30, 2020 23:36 UTC 364d etcd-ca no

etcd-peer Dec 30, 2020 23:36 UTC 364d etcd-ca no

etcd-server Dec 30, 2020 23:36 UTC 364d etcd-ca no

front-proxy-client Dec 30, 2020 23:36 UTC 364d front-proxy-ca no

scheduler.conf Dec 30, 2020 23:36 UTC 364d no

CERTIFICATE AUTHORITY EXPIRES RESIDUAL TIME EXTERNALLY MANAGED

ca Dec 28, 2029 23:36 UTC 9y no

etcd-ca Dec 28, 2029 23:36 UTC 9y no

front-proxy-ca Dec 28, 2029 23:36 UTC 9y no

该命令显示 /etc/kubernetes/pki 文件夹中的客户端证书以及

kubeadm(admin.conf, controller-manager.conf 和 scheduler.conf)

使用的 KUBECONFIG 文件中嵌入的客户端证书的到期时间/剩余时间。

另外, kubeadm 会通知用户证书是否由外部管理; 在这种情况下,用户应该小心的手动/使用其他工具来管理证书更新。

kubeadm 不能管理由外部 CA 签名的证书

kubelet.conf,因为 kubeadm 将 kubelet 配置为

自动更新证书。

轮换的证书位于目录 /var/lib/kubelet/pki。

要修复过期的 kubelet 客户端证书,请参阅

kubelet 客户端证书轮换失败。

在通过 kubeadm init 创建的节点上,在 kubeadm 1.17 版本之前有一个

缺陷,该缺陷

使得你必须手动修改 kubelet.conf 文件的内容。

kubeadm init 操作结束之后,你必须更新 kubelet.conf 文件

将 client-certificate-data 和 client-key-data 改为如下所示的内容

以便使用轮换后的 kubelet 客户端证书:

client-certificate: /var/lib/kubelet/pki/kubelet-client-current.pem

client-key: /var/lib/kubelet/pki/kubelet-client-current.pem

kubeadm 会在控制面

升级

的时候更新所有证书。

这个功能旨在解决最简单的用例;如果你对此类证书的更新没有特殊要求, 并且定期执行 Kubernetes 版本升级(每次升级之间的间隔时间少于 1 年), 则 kubeadm 将确保你的集群保持最新状态并保持合理的安全性。

如果你对证书更新有更复杂的需求,则可通过将 --certificate-renewal=false 传递给

kubeadm upgrade apply 或者 kubeadm upgrade node,从而选择不采用默认行为。

kubeadm update node 执行时 --certificate-renewal 的默认值被设置为 false。

在这种情况下,你需要显式地设置 --certificate-renewal=true。

你能随时通过 kubeadm certs renew 命令手动更新你的证书。

此命令用 CA (或者 front-proxy-CA )证书和存储在 /etc/kubernetes/pki 中的密钥执行更新。

执行完此命令之后你需要重启控制面 Pods。因为动态证书重载目前还不被所有组件和证书支持,所有这项操作是必须的。

静态 Pods 是被本地 kubelet 而不是 API Server 管理,

所以 kubectl 不能用来删除或重启他们。

要重启静态 Pod 你可以临时将清单文件从 /etc/kubernetes/manifests/ 移除并等待 20 秒

(参考 KubeletConfiguration 结构 中的fileCheckFrequency 值)。

如果 Pod 不在清单目录里,kubelet将会终止它。

在另一个 fileCheckFrequency 周期之后你可以将文件移回去,为了组件可以完成 kubelet 将重新创建 Pod 和证书更新。

certs renew 使用现有的证书作为属性 (Common Name、Organization、SAN 等) 的权威来源,

而不是 kubeadm-config ConfigMap 。强烈建议使它们保持同步。

kubeadm certs renew提供以下选项:

Kubernetes 证书通常在一年后到期。

--csr-only 可用于经过一个外部 CA 生成的证书签名请求来更新证书(无需实际替换更新证书);

更多信息请参见下节。本节提供有关如何使用 Kubernetes 证书 API 执行手动证书更新的更多详细信息。

Kubernetes 证书颁发机构不是开箱即用。

你可以配置外部签名者,例如

cert-manager,

也可以使用内置签名者。

内置签名者是

kube-controller-manager

的一部分。

要激活内置签名者,请传递 --cluster-signing-cert-file 和 --cluster-signing-key-file 参数。

如果你正在创建一个新的集群,你可以使用 kubeadm 的 配置文件。

apiVersion: kubeadm.k8s.io/v1beta3

kind: ClusterConfiguration

controllerManager:

extraArgs:

cluster-signing-cert-file: /etc/kubernetes/pki/ca.crt

cluster-signing-key-file: /etc/kubernetes/pki/ca.key

有关使用 Kubernetes API 创建 CSR 的信息, 请参见创建 CertificateSigningRequest。

本节提供有关如何使用外部 CA 执行手动更新证书的更多详细信息。

为了更好的与外部 CA 集成,kubeadm 还可以生成证书签名请求(CSR)。 CSR 表示向 CA 请求客户的签名证书。 在 kubeadm 术语中,通常由磁盘 CA 签名的任何证书都可以作为 CSR 生成。但是,CA 不能作为 CSR 生成。

你可以通过 kubeadm certs renew --csr-only 命令创建证书签名请求。

CSR 和随附的私钥都在输出中给出。

你可以传入一个带有 --csr-dir 的目录,将 CRS 输出到指定位置。

如果未指定 --csr-dir ,则使用默认证书目录(/etc/kubernetes/pki)。

证书可以通过 kubeadm certs renew --csr-only 来续订。

和 kubeadm init 一样,可以使用 --csr-dir 标志指定一个输出目录。

CSR 签署证书后,必须将证书和私钥复制到 PKI 目录(默认情况下为 /etc/kubernetes/pki)。

CSR 中包含一个证书的名字,域和 IP,但是未指定用法。 颁发证书时,CA 有责任指定正确的证书用法

openssl 中,这是通过

openssl ca 命令

来完成的。cfssl 中,这是通过

在配置文件中指定用法

来完成的。使用首选方法对证书签名后,必须将证书和私钥复制到 PKI 目录(默认为 /etc/kubernetes/pki )。

kubeadm 并不直接支持对 CA 证书的轮换或者替换。

关于手动轮换或者置换 CA 的更多信息,可参阅 手动轮换 CA 证书。

默认情况下,kubeadm 所部署的 kubelet 服务证书是自签名(Self-Signed))。 这意味着从 metrics-server 这类外部服务发起向 kubelet 的链接时无法使用 TLS 来完成保护。

要在新的 kubeadm 集群中配置 kubelet 以使用被正确签名的服务证书,

你必须向 kubeadm init 传递如下最小配置数据:

apiVersion: kubeadm.k8s.io/v1beta3

kind: ClusterConfiguration

---

apiVersion: kubelet.config.k8s.io/v1beta1

kind: KubeletConfiguration

serverTLSBootstrap: true

如果你已经创建了集群,你必须通过执行下面的操作来完成适配:

kube-system 名字空间中名为 kubelet-config-1.23

的 ConfigMap 并编辑之。

在该 ConfigMap 中,kubelet 键下面有一个

KubeletConfiguration

文档作为其取值。编辑该 KubeletConfiguration 文档以设置

serverTLSBootstrap: true。/var/lib/kubelet/config.yaml 文件中添加

serverTLSBootstrap: true 字段,并使用 systemctl restart kubelet

来重启 kubelet。字段 serverTLSBootstrap 将允许启动引导 kubelet 的服务证书,方式

是从 certificates.k8s.io API 处读取。这种方式的一种局限在于这些

证书的 CSR(证书签名请求)不能被 kube-controller-manager 中默认的

签名组件

kubernetes.io/kubelet-serving

批准。需要用户或者第三方控制器来执行此操作。

可以使用下面的命令来查看 CSR:

kubectl get csr

NAME AGE SIGNERNAME REQUESTOR CONDITION

csr-9wvgt 112s kubernetes.io/kubelet-serving system:node:worker-1 Pending

csr-lz97v 1m58s kubernetes.io/kubelet-serving system:node:control-plane-1 Pending

你可以执行下面的操作来批准这些请求:

kubectl certificate approve <CSR-名称>

默认情况下,这些服务证书上会在一年后过期。

kubeadm 将 KubeletConfiguration 的 rotateCertificates 字段设置为

true;这意味着证书快要过期时,会生成一组针对服务证书的新的 CSR,而

这些 CSR 也要被批准才能完成证书轮换。

要进一步了解这里的细节,可参阅

证书轮换

文档。

如果你在寻找一种能够自动批准这些 CSR 的解决方案,建议你与你的云提供商 联系,询问他们是否有 CSR 签名组件,用来以带外(out-of-band)的方式检查 节点的标识符。

也可以使用第三方定制的控制器:

除非既能够验证 CSR 中的 CommonName,也能检查请求的 IP 和域名, 这类控制器还算不得安全的机制。 只有完成彻底的检查,才有可能避免有恶意的、能够访问 kubelet 客户端证书的第三方 为任何 IP 或域名请求服务证书。

本页阐述如何配置 kubelet 的 cgroup 驱动以匹配 kubeadm 集群中的容器运行时的 cgroup 驱动。

你应该熟悉 Kubernetes 的容器运行时需求。

容器运行时页面提到:

由于 kubeadm 把 kubelet 视为一个系统服务来管理,所以对基于 kubeadm 的安装,

我们推荐使用 systemd 驱动,不推荐 cgroupfs 驱动。

此页还详述了如何安装若干不同的容器运行时,并将 systemd 设为其默认驱动。

kubeadm 支持在执行 kubeadm init 时,传递一个 KubeletConfiguration 结构体。

KubeletConfiguration 包含 cgroupDriver 字段,可用于控制 kubelet 的 cgroup 驱动。

KubeletConfiguration 中设置 cgroupDriver 字段,

kubeadm init 会将它设置为默认值 systemd。

这是一个最小化的示例,其中显式的配置了此字段:

# kubeadm-config.yaml

kind: ClusterConfiguration

apiVersion: kubeadm.k8s.io/v1beta3

kubernetesVersion: v1.21.0

---

kind: KubeletConfiguration

apiVersion: kubelet.config.k8s.io/v1beta1

cgroupDriver: systemd

这样一个配置文件就可以传递给 kubeadm 命令了:

kubeadm init --config kubeadm-config.yaml

Kubeadm 对集群所有的节点,使用相同的 KubeletConfiguration。

KubeletConfiguration 存放于 kube-system 命名空间下的某个

ConfigMap 对象中。

执行 init、join 和 upgrade 等子命令会促使 kubeadm

将 KubeletConfiguration 写入到文件 /var/lib/kubelet/config.yaml 中,

继而把它传递给本地节点的 kubelet。

cgroupfs 驱动正如本指南阐述的:不推荐与 kubeadm 一起使用 cgroupfs 驱动。

如仍需使用 cgroupfs,

且要防止 kubeadm upgrade 修改现有系统中 KubeletConfiguration 的 cgroup 驱动,

你必须显式声明它的值。

此方法应对的场景为:在将来某个版本的 kubeadm 中,你不想使用默认的 systemd 驱动。

参阅以下章节“修改 kubelet 的 ConfigMap”,了解显式设置该值的方法。

如果你希望配置容器运行时来使用 cgroupfs 驱动,

则必须参考所选容器运行时的文档。

systemd 驱动要将现有 kubeadm 集群的 cgroup 驱动就地升级为 systemd,

需要执行一个与 kubelet 升级类似的过程。

该过程必须包含下面两个步骤:

systemd 的新节点替换掉集群中的老节点。

按这种方法,在加入新节点、确保工作负载可以安全迁移到新节点、及至删除旧节点这一系列操作之前,

只需执行以下第一个步骤。

用命令 kubectl get cm -n kube-system | grep kubelet-config 找到 kubelet 的 ConfigMap 名称。

运行 kubectl edit cm kubelet-config-x.yy -n kube-system (把 x.yy 替换为 Kubernetes 版本)。

修改现有 cgroupDriver 的值,或者新增如下式样的字段:

cgroupDriver: systemd

该字段必须出现在 ConfigMap 的 kubelet: 小节下。

对于集群中的每一个节点:

kubectl drain <node-name> --ignore-daemonsets,以

腾空节点systemctl stop kubelet,以停止 kubeletsystemd/var/lib/kubelet/config.yaml 中添加设置 cgroupDriver: systemdsystemctl start kubelet,以启动 kubeletkubectl uncordon <node-name>,以

取消节点隔离在节点上依次执行上述步骤,确保工作负载有充足的时间被调度到其他节点。

流程完成后,确认所有节点和工作负载均健康如常。

本页介绍如何将 kubeadm 创建的 Kubernetes 集群从 1.22.x 版本

升级到 1.23.x 版本以及从 1.23.x

升级到 1.23.y(其中 y > x)。略过次版本号的升级是

不被支持的。

要查看 kubeadm 创建的有关旧版本集群升级的信息,请参考以下页面:

升级工作的基本流程如下:

kubeadm upgrade 不会影响你的工作负载,只会涉及 Kubernetes 内部的组件,但备份终究是好的。使用操作系统的包管理器找到最新的补丁版本 Kubernetes 1.23:

apt update

apt-cache madison kubeadm

# 在列表中查找最新的 1.23 版本

# 它看起来应该是 1.23.x-00,其中 x 是最新的补丁版本

yum list --showduplicates kubeadm --disableexcludes=kubernetes

# 在列表中查找最新的 1.23 版本

# 它看起来应该是 1.23.x-0,其中 x 是最新的补丁版本

控制面节点上的升级过程应该每次处理一个节点。

首先选择一个要先行升级的控制面节点。该节点上必须拥有

/etc/kubernetes/admin.conf 文件。

升级第一个控制面节点

# 用最新的补丁版本号替换 1.23.x-00 中的 x

apt-mark unhold kubeadm && \

apt-get update && apt-get install -y kubeadm=1.23.x-00 && \

apt-mark hold kubeadm

-

# 从 apt-get 1.1 版本起,你也可以使用下面的方法

apt-get update && \

apt-get install -y --allow-change-held-packages kubeadm=1.23.x-00

# 用最新的补丁版本号替换 1.23.x-0 中的 x

yum install -y kubeadm-1.23.x-0 --disableexcludes=kubernetes

验证下载操作正常,并且 kubeadm 版本正确:

kubeadm version

验证升级计划:

kubeadm upgrade plan

此命令检查你的集群是否可被升级,并取回你要升级的目标版本。 命令也会显示一个包含组件配置版本状态的表格。

kubeadm upgrade 也会自动对 kubeadm 在节点上所管理的证书执行续约操作。

如果需要略过证书续约操作,可以使用标志 --certificate-renewal=false。

更多的信息,可参阅证书管理指南。

如果 kubeadm upgrade plan 给出任何需要手动升级的组件配置,用户必须

通过 --config 命令行标志向 kubeadm upgrade apply 命令提供替代的配置文件。

如果不这样做,kubeadm upgrade apply 会出错并退出,不再执行升级操作。

选择要升级到的目标版本,运行合适的命令。例如:

# 将 x 替换为你为此次升级所选择的补丁版本号

sudo kubeadm upgrade apply v1.23.x

一旦该命令结束,你应该会看到:

[upgrade/successful] SUCCESS! Your cluster was upgraded to "v1.23.x". Enjoy!

[upgrade/kubelet] Now that your control plane is upgraded, please proceed with upgrading your kubelets if you haven't already done so.

手动升级你的 CNI 驱动插件。

你的容器网络接口(CNI)驱动应该提供了程序自身的升级说明。 参阅插件页面查找你的 CNI 驱动, 并查看是否需要其他升级步骤。

如果 CNI 驱动作为 DaemonSet 运行,则在其他控制平面节点上不需要此步骤。

对于其它控制面节点

与第一个控制面节点相同,但是使用:

sudo kubeadm upgrade node

而不是:

sudo kubeadm upgrade apply

此外,不需要执行 kubeadm upgrade plan 和更新 CNI 驱动插件的操作。

通过将节点标记为不可调度并腾空节点为节点作升级准备:

# 将 <node-to-drain> 替换为你要腾空的控制面节点名称

kubectl drain <node-to-drain> --ignore-daemonsets

升级 kubelet 和 kubectl

# 用最新的补丁版本替换 1.23.x-00 中的 x apt-mark unhold kubelet kubectl && \ apt-get update && apt-get install -y kubelet=1.23.x-00 kubectl=1.23.x-00 && \ apt-mark hold kubelet kubectl - # 从 apt-get 的 1.1 版本开始,你也可以使用下面的方法: apt-get update && \ apt-get install -y --allow-change-held-packages kubelet=1.23.x-00 kubectl=1.23.x-00

# 用最新的补丁版本号替换 1.23.x-00 中的 x yum install -y kubelet-1.23.x-0 kubectl-1.23.x-0 --disableexcludes=kubernetes

重启 kubelet

sudo systemctl daemon-reload

sudo systemctl restart kubelet

通过将节点标记为可调度,让其重新上线:

# 将 <node-to-drain> 替换为你的节点名称

kubectl uncordon <node-to-drain>

工作节点上的升级过程应该一次执行一个节点,或者一次执行几个节点, 以不影响运行工作负载所需的最小容量。

升级 kubeadm:

# 将 1.23.x-00 中的 x 替换为最新的补丁版本号

apt-mark unhold kubeadm && \

apt-get update && apt-get install -y kubeadm=1.23.x-00 && \

apt-mark hold kubeadm

-

# 从 apt-get 的 1.1 版本开始,你也可以使用下面的方法:

apt-get update && \

apt-get install -y --allow-change-held-packages kubeadm=1.23.x-00

# 用最新的补丁版本替换 1.23.x-00 中的 x

yum install -y kubeadm-1.23.x-0 --disableexcludes=kubernetes

对于工作节点,下面的命令会升级本地的 kubelet 配置:

sudo kubeadm upgrade node

将节点标记为不可调度并驱逐所有负载,准备节点的维护:

# 将 <node-to-drain> 替换为你正在腾空的节点的名称

kubectl drain <node-to-drain> --ignore-daemonsets

升级 kubelet 和 kubectl:

# 将 1.23.x-00 中的 x 替换为最新的补丁版本

apt-mark unhold kubelet kubectl && \

apt-get update && apt-get install -y kubelet=1.23.x-00 kubectl=1.23.x-00 && \

apt-mark hold kubelet kubectl

# 从 apt-get 的 1.1 版本开始,你也可以使用下面的方法:

apt-get update && \

apt-get install -y --allow-change-held-packages kubelet=1.23.x-00 kubectl=1.23.x-00

# 将 1.23.x-0 x 替换为最新的补丁版本

yum install -y kubelet-1.23.x-0 kubectl-1.23.x-0 --disableexcludes=kubernetes

重启 kubelet

sudo systemctl daemon-reload

sudo systemctl restart kubelet

通过将节点标记为可调度,让节点重新上线:

# 将 <node-to-drain> 替换为当前节点的名称

kubectl uncordon <node-to-drain>

在所有节点上升级 kubelet 后,通过从 kubectl 可以访问集群的任何位置运行以下命令, 验证所有节点是否再次可用:

kubectl get nodes

STATUS 应显示所有节点为 Ready 状态,并且版本号已经被更新。

如果 kubeadm upgrade 失败并且没有回滚,例如由于执行期间节点意外关闭,

你可以再次运行 kubeadm upgrade。

此命令是幂等的,并最终确保实际状态是你声明的期望状态。

要从故障状态恢复,你还可以运行 kubeadm upgrade --force 而无需更改集群正在运行的版本。

在升级期间,kubeadm 向 /etc/kubernetes/tmp 目录下的如下备份文件夹写入数据:

kubeadm-backup-etcd-<date>-<time>kubeadm-backup-manifests-<date>-<time>kubeadm-backup-etcd 包含当前控制面节点本地 etcd 成员数据的备份。

如果 etcd 升级失败并且自动回滚也无法修复,则可以将此文件夹中的内容复制到

/var/lib/etcd 进行手工修复。如果使用的是外部的 etcd,则此备份文件夹为空。

kubeadm-backup-manifests 包含当前控制面节点的静态 Pod 清单文件的备份版本。

如果升级失败并且无法自动回滚,则此文件夹中的内容可以复制到

/etc/kubernetes/manifests 目录实现手工恢复。

如果由于某些原因,在升级前后某个组件的清单未发生变化,则 kubeadm 也不会为之

生成备份版本。

kubeadm upgrade apply 做了以下工作:

Ready 状态CoreDNS 和 kube-proxy 清单,并强制创建所有必需的 RBAC 规则。kubeadm upgrade node 在其他控制平节点上执行以下操作:

ClusterConfiguration。kubeadm upgrade node 在工作节点上完成以下工作:

ClusterConfiguration。Kubernetes v1.18 [beta]

你可以使用 Kubernetes 来混合运行 Linux 和 Windows 节点,这样你就可以 混合使用运行于 Linux 上的 Pod 和运行于 Windows 上的 Pod。 本页面展示如何将 Windows 节点注册到你的集群。

kubectl version.

获取 Windows Server 2019 或更高版本的授权 以便配置托管 Windows 容器的 Windows 节点。 如果你在使用 VXLAN/覆盖(Overlay)联网设施,则你还必须安装 KB4489899。

一个利用 kubeadm 创建的基于 Linux 的 Kubernetes 集群;你能访问该集群的控制面 (参见使用 kubeadm 创建一个单控制面的集群)。

一旦你有了一个基于 Linux 的 Kubernetes 控制面节点,你就可以为其选择联网方案。 出于简单考虑,本指南展示如何使用 VXLAN 模式的 Flannel。

为 Flannel 准备 Kubernetes 的控制面

在我们的集群中,建议对 Kubernetes 的控制面进行少许准备处理。 建议在使用 Flannel 时为 iptables 链启用桥接方式的 IPv4 流处理, 必须在所有 Linux 节点上执行如下命令:

sudo sysctl net.bridge.bridge-nf-call-iptables=1

下载并配置 Linux 版本的 Flannel

下载最新的 Flannel 清单文件:

wget https://raw.githubusercontent.com/coreos/flannel/master/Documentation/kube-flannel.yml

修改 Flannel 清单中的 net-conf.json 部分,将 VNI 设置为 4096,并将 Port 设置为 4789。

结果看起来像下面这样:

net-conf.json: |

{

"Network": "10.244.0.0/16",

"Backend": {

"Type": "vxlan",

"VNI": 4096,

"Port": 4789

}

}

Type 值设置为

"host-gw",并忽略 VNI 和 Port 的设置。

应用 Flannel 清单并验证

首先应用 Flannel 配置:

kubectl apply -f kube-flannel.yml

几分钟之后,如果 Flannel Pod 网络被正确部署,你应该会看到所有 Pods 都处于运行中状态。

kubectl get pods -n kube-system

输出中应该包含处于运行中状态的 Linux Flannel DaemonSet:

NAMESPACE NAME READY STATUS RESTARTS AGE

...

kube-system kube-flannel-ds-54954 1/1 Running 0 1m

添加 Windows Flannel 和 kube-proxy DaemonSet

现在你可以添加 Windows 兼容版本的 Flannel 和 kube-proxy。为了确保你能获得兼容 版本的 kube-proxy,你需要替换镜像中的标签。 下面的例子中展示的是针对 Kubernetes v1.23.0 版本的用法, 不过你应该根据你自己的集群部署调整其中的版本号。

curl -L https://github.com/kubernetes-sigs/sig-windows-tools/releases/latest/download/kube-proxy.yml | sed 's/VERSION/v1.23.0/g' | kubectl apply -f -

kubectl apply -f https://github.com/kubernetes-sigs/sig-windows-tools/releases/latest/download/flannel-overlay.yml

如果你在 Windows 节点上使用的不是以太网(即,"Ethernet0 2")接口,你需要

修改 flannel-host-gw.yml 或 flannel-overlay.yml 文件中的下面这行:

wins cli process run --path /k/flannel/setup.exe --args "--mode=overlay --interface=Ethernet"

在其中根据情况设置要使用的网络接口。

# Example

curl -L https://github.com/kubernetes-sigs/sig-windows-tools/releases/latest/download/flannel-overlay.yml | sed 's/Ethernet/Ethernet0 2/g' | kubectl apply -f -

Windows 节的所有代码片段都需要在 PowerShell 环境中执行,并且要求在 Windows 工作节点上具有提升的权限(Administrator)。

Install-WindowsFeature -Name containers

安装 Docker 操作指南在 Install Docker Engine - Enterprise on Windows Servers。

curl.exe -LO https://raw.githubusercontent.com/kubernetes-sigs/sig-windows-tools/master/kubeadm/scripts/PrepareNode.ps1

.\PrepareNode.ps1 -KubernetesVersion v1.23.0

kubeadm 添加节点当你在控制面主机上运行 kubeadm init 时,输出了一个命令。现在运行这个命令。

如果你找不到这个命令,或者命令中对应的令牌已经过期,你可以(在一个控制面主机上)运行

kubeadm token create --print-join-command 来生成新的令牌和 join 命令。

curl.exe -LO https://github.com/kubernetes-sigs/sig-windows-tools/releases/latest/download/Install-Containerd.ps1

.\Install-Containerd.ps1

要安装特定版本的 containerD,使用参数 -ContainerDVersion指定版本。

# Example

.\Install-Containerd.ps1 -ContainerDVersion 1.4.1

如果你在 Windows 节点上使用了与 Ethernet 不同的接口(例如 "Ethernet0 2"),使用参数 -netAdapterName 指定名称。

# Example

.\Install-Containerd.ps1 -netAdapterName "Ethernet0 2"

curl.exe -LO https://raw.githubusercontent.com/kubernetes-sigs/sig-windows-tools/master/kubeadm/scripts/PrepareNode.ps1

.\PrepareNode.ps1 -KubernetesVersion v1.23.0 -ContainerRuntime containerD

kubeadm 添加节点使用当你在控制面主机上运行 kubeadm init 时得到的命令。

如果你找不到这个命令,或者命令中对应的令牌已经过期,你可以(在一个控制面主机上)运行

kubeadm token create --print-join-command 来生成新的令牌和 join 命令。

--cri-socket "npipe:////./pipe/containerd-containerd" to the kubeadm call

你现在应该能够通过运行下面的命令来查看集群中的 Windows 节点了:

kubectl get nodes -o wide

如果你的新节点处于 NotReady 状态,很可能的原因是系统仍在下载 Flannel 镜像。

你可以像之前一样,通过检查 kube-system 名字空间中的 Flannel Pods 来了解

安装进度。

kubectl -n kube-system get pods -l app=flannel

一旦 Flannel Pod 运行起来,你的节点就应该能进入 Ready 状态并可

用来处理负载。

Kubernetes v1.18 [beta]

本页解释如何升级用 kubeadm 创建的 Windows 节点。

你必须拥有一个 Kubernetes 的集群,同时你的 Kubernetes 集群必须带有 kubectl 命令行工具。 建议在至少有两个节点的集群上运行本教程,且这些节点不作为控制平面主机。 如果你还没有集群,你可以通过 Minikube 构建一个你自己的集群,或者你可以使用下面任意一个 Kubernetes 工具构建:

您的 Kubernetes 服务器版本必须不低于版本 1.17. 要获知版本信息,请输入kubectl version.

在 Windows 节点上升级 kubeadm:

# 将 v1.23.0 替换为你希望的版本

curl.exe -Lo C:\k\kubeadm.exe https://dl.k8s.io//bin/windows/amd64/kubeadm.exe

在一个能访问到 Kubernetes API 的机器上,将 Windows 节点标记为不可调度并 驱逐其上的所有负载,以便准备节点维护操作:

# 将 <要腾空的节点> 替换为你要腾空的节点的名称

kubectl drain <要腾空的节点> -ignore-daemonsets

你应该会看到类似下面的输出:

node/ip-172-31-85-18 cordoned

node/ip-172-31-85-18 drained

在 Windows 节点上,执行下面的命令来同步新的 kubelet 配置:

kubeadm upgrade node

在 Windows 节点上升级并重启 kubelet:

stop-service kubelet

curl.exe -Lo C:\k\kubelet.exe https://dl.k8s.io//bin/windows/amd64/kubelet.exe

restart-service kubelet

从一台能够访问到 Kubernetes API 的机器上,通过将节点标记为可调度,使之 重新上线:

# 将 <要腾空的节点> 替换为你的节点名称

kubectl uncordon <要腾空的节点>

在一台可访问 Kubernetes API 的机器上和,将 v1.23.0 替换成你 期望的版本后再次执行下面的命令:

curl -L https://github.com/kubernetes-sigs/sig-windows-tools/releases/latest/download/kube-proxy.yml | sed 's/VERSION/v1.23.0/g' | kubectl apply -f -

本文介绍怎样给命名空间配置默认的内存请求和限制。 如果在一个有默认内存限制的命名空间创建容器,该容器没有声明自己的内存限制时, 将会被指定默认内存限制。 Kubernetes 还为某些情况指定了默认的内存请求,本章后面会进行介绍。

你必须拥有一个 Kubernetes 的集群,同时你的 Kubernetes 集群必须带有 kubectl 命令行工具。 建议在至少有两个节点的集群上运行本教程,且这些节点不作为控制平面主机。 如果你还没有集群,你可以通过 Minikube 构建一个你自己的集群,或者你可以使用下面任意一个 Kubernetes 工具构建:

要获知版本信息,请输入kubectl version.

你的集群中的每个节点必须至少有 2 GiB 的内存。

创建一个命名空间,以便本练习中所建的资源与集群的其余资源相隔离。

kubectl create namespace default-mem-example

这里给出了一个限制范围对象的配置文件。该配置声明了一个默认的内存请求和一个默认的内存限制。

apiVersion: v1

kind: LimitRange

metadata:

name: mem-limit-range

spec:

limits:

- default:

memory: 512Mi

defaultRequest:

memory: 256Mi

type: Container

在 default-mem-example 命名空间创建限制范围:

kubectl apply -f https://k8s.io/examples/admin/resource/memory-defaults.yaml --namespace=default-mem-example

现在,如果在 default-mem-example 命名空间创建容器,并且该容器没有声明自己的内存请求和限制值, 它将被指定默认的内存请求 256 MiB 和默认的内存限制 512 MiB。

下面是具有一个容器的 Pod 的配置文件。 容器未指定内存请求和限制。

apiVersion: v1

kind: Pod

metadata:

name: default-mem-demo

spec:

containers:

- name: default-mem-demo-ctr

image: nginx

创建 Pod

kubectl apply -f https://k8s.io/examples/admin/resource/memory-defaults-pod.yaml --namespace=default-mem-example

查看 Pod 的详情:

kubectl get pod default-mem-demo --output=yaml --namespace=default-mem-example

输出内容显示该 Pod 的容器有 256 MiB 的内存请求和 512 MiB 的内存限制。 这些都是 LimitRange 设置的默认值。

containers:

- image: nginx

imagePullPolicy: Always

name: default-mem-demo-ctr

resources:

limits:

memory: 512Mi

requests:

memory: 256Mi

删除你的 Pod:

kubectl delete pod default-mem-demo --namespace=default-mem-example

这里给出了包含一个容器的 Pod 的配置文件。该容器声明了内存限制,而没有声明内存请求:

apiVersion: v1

kind: Pod

metadata:

name: default-mem-demo-2

spec:

containers:

- name: default-mem-demo-2-ctr

image: nginx

resources:

limits:

memory: "1Gi"

创建 Pod:

kubectl apply -f https://k8s.io/examples/admin/resource/memory-defaults-pod-2.yaml --namespace=default-mem-example

查看 Pod 的详情:

kubectl get pod default-mem-demo-2 --output=yaml --namespace=default-mem-example

输出结果显示容器的内存请求被设置为它的内存限制相同的值。注意该容器没有被指定默认的内存请求值 256MiB。

resources:

limits:

memory: 1Gi

requests:

memory: 1Gi

这里给出了一个包含一个容器的 Pod 的配置文件。该容器声明了内存请求,但没有内存限制:

apiVersion: v1

kind: Pod

metadata:

name: default-mem-demo-3

spec:

containers:

- name: default-mem-demo-3-ctr

image: nginx

resources:

requests:

memory: "128Mi"

创建 Pod:

kubectl apply -f https://k8s.io/examples/admin/resource/memory-defaults-pod-3.yaml --namespace=default-mem-example

查看 Pod 声明:

kubectl get pod default-mem-demo-3 --output=yaml --namespace=default-mem-example

输出结果显示该容器的内存请求被设置为了容器配置文件中声明的数值。 容器的内存限制被设置为 512MiB,即命名空间的默认内存限制。

resources:

limits:

memory: 512Mi

requests:

memory: 128Mi

如果你的命名空间有资源配额,那么默认内存限制是很有帮助的。 下面是一个例子,通过资源配额为命名空间设置两项约束:

如果一个容器没有声明自己的内存限制,会被指定默认限制,然后它才会被允许在限定了配额的命名空间中运行。

删除你的命名空间:

kubectl delete namespace default-mem-example

本章介绍怎样为命名空间配置默认的 CPU 请求和限制。 一个 Kubernetes 集群可被划分为多个命名空间。如果在配置了 CPU 限制的命名空间创建容器, 并且该容器没有声明自己的 CPU 限制,那么这个容器会被指定默认的 CPU 限制。 Kubernetes 在一些特定情况还会指定 CPU 请求,本文后续章节将会对其进行解释。

你必须拥有一个 Kubernetes 的集群,同时你的 Kubernetes 集群必须带有 kubectl 命令行工具。 建议在至少有两个节点的集群上运行本教程,且这些节点不作为控制平面主机。 如果你还没有集群,你可以通过 Minikube 构建一个你自己的集群,或者你可以使用下面任意一个 Kubernetes 工具构建:

要获知版本信息,请输入kubectl version.

创建一个命名空间,以便本练习中创建的资源和集群的其余部分相隔离。

kubectl create namespace default-cpu-example

这里给出了 LimitRange 对象的配置文件。该配置声明了一个默认的 CPU 请求和一个默认的 CPU 限制。

apiVersion: v1

kind: LimitRange

metadata:

name: cpu-limit-range

spec:

limits:

- default:

cpu: 1

defaultRequest:

cpu: 0.5

type: Container

在命名空间 default-cpu-example 中创建 LimitRange 对象:

kubectl apply -f https://k8s.io/examples/admin/resource/cpu-defaults.yaml --namespace=default-cpu-example

现在如果在 default-cpu-example 命名空间创建一个容器,该容器没有声明自己的 CPU 请求和限制时, 将会给它指定默认的 CPU 请求0.5和默认的 CPU 限制值1.

这里给出了包含一个容器的 Pod 的配置文件。该容器没有声明 CPU 请求和限制。

apiVersion: v1

kind: Pod

metadata:

name: default-cpu-demo

spec:

containers:

- name: default-cpu-demo-ctr

image: nginx

创建 Pod。

kubectl apply -f https://k8s.io/examples/admin/resource/cpu-defaults-pod.yaml --namespace=default-cpu-example

查看该 Pod 的声明:

kubectl get pod default-cpu-demo --output=yaml --namespace=default-cpu-example

输出显示该 Pod 的容器有一个500 millicpus的 CPU 请求和一个1 cpu的 CPU 限制。这些是 LimitRange 声明的默认值。

containers:

- image: nginx

imagePullPolicy: Always

name: default-cpu-demo-ctr

resources:

limits:

cpu: "1"

requests:

cpu: 500m

这是包含一个容器的 Pod 的配置文件。该容器声明了 CPU 限制,而没有声明 CPU 请求。

apiVersion: v1

kind: Pod

metadata:

name: default-cpu-demo-2

spec:

containers:

- name: default-cpu-demo-2-ctr

image: nginx

resources:

limits:

cpu: "1"

创建 Pod

kubectl apply -f https://k8s.io/examples/admin/resource/cpu-defaults-pod-2.yaml --namespace=default-cpu-example

查看 Pod 的声明:

kubectl get pod default-cpu-demo-2 --output=yaml --namespace=default-cpu-example

输出显示该容器的 CPU 请求和 CPU 限制设置相同。注意该容器没有被指定默认的 CPU 请求值0.5 cpu。

resources:

limits:

cpu: "1"

requests:

cpu: "1"

这里给出了包含一个容器的 Pod 的配置文件。该容器声明了 CPU 请求,而没有声明 CPU 限制。

apiVersion: v1

kind: Pod

metadata:

name: default-cpu-demo-3

spec:

containers:

- name: default-cpu-demo-3-ctr

image: nginx

resources:

requests:

cpu: "0.75"

创建 Pod:

kubectl apply -f https://k8s.io/examples/admin/resource/cpu-defaults-pod-3.yaml --namespace=default-cpu-example

查看 Pod 的规约:

kubectl get pod default-cpu-demo-3 --output=yaml --namespace=default-cpu-example

结果显示该容器的 CPU 请求被设置为容器配置文件中声明的数值。 容器的CPU限制被设置为 1 CPU,即该命名空间的默认 CPU 限制值。

resources:

limits:

cpu: "1"

requests:

cpu: 750m

如果你的命名空间有一个 资源配额, 那么有一个默认的 CPU 限制是有帮助的。这里有资源配额强加给命名空间的两条限制:

如果容器没有声明自己的 CPU 限制,将会给它一个默认限制,这样它就能被允许运行在一个有配额限制的命名空间中。

删除你的命名空间:

kubectl delete namespace constraints-cpu-example

本页介绍如何设置在命名空间中运行的容器使用的内存的最小值和最大值。 你可以在 LimitRange 对象中指定最小和最大内存值。如果 Pod 不满足 LimitRange 施加的约束,则无法在命名空间中创建它。

你必须拥有一个 Kubernetes 的集群,同时你的 Kubernetes 集群必须带有 kubectl 命令行工具。 建议在至少有两个节点的集群上运行本教程,且这些节点不作为控制平面主机。 如果你还没有集群,你可以通过 Minikube 构建一个你自己的集群,或者你可以使用下面任意一个 Kubernetes 工具构建:

要获知版本信息,请输入kubectl version.

集群中每个节点必须至少要有 1 GiB 的内存。

创建一个命名空间,以便在此练习中创建的资源与群集的其余资源隔离。

kubectl create namespace constraints-mem-example

下面是 LimitRange 的配置文件:

apiVersion: v1

kind: LimitRange

metadata:

name: mem-min-max-demo-lr

spec:

limits:

- max:

memory: 1Gi

min:

memory: 500Mi

type: Container

创建 LimitRange:

kubectl apply -f https://k8s.io/examples/admin/resource/memory-constraints.yaml --namespace=constraints-mem-example

查看 LimitRange 的详情:

kubectl get limitrange mem-min-max-demo-lr --namespace=constraints-mem-example --output=yaml

输出显示预期的最小和最大内存约束。 但请注意,即使你没有在 LimitRange 的配置文件中指定默认值,也会自动创建它们。

limits:

- default:

memory: 1Gi

defaultRequest:

memory: 1Gi

max:

memory: 1Gi

min:

memory: 500Mi

type: Container

现在,只要在 constraints-mem-example 命名空间中创建容器,Kubernetes 就会执行下面的步骤:

如果 Container 未指定自己的内存请求和限制,将为它指定默认的内存请求和限制。

验证 Container 的内存请求是否大于或等于500 MiB。

验证 Container 的内存限制是否小于或等于1 GiB。

这里给出了包含一个 Container 的 Pod 配置文件。Container 声明了 600 MiB 的内存请求和 800 MiB 的内存限制, 这些满足了 LimitRange 施加的最小和最大内存约束。

apiVersion: v1

kind: Pod

metadata:

name: constraints-mem-demo

spec:

containers:

- name: constraints-mem-demo-ctr

image: nginx

resources:

limits:

memory: "800Mi"

requests:

memory: "600Mi"

创建 Pod:

kubectl apply -f https://k8s.io/examples/admin/resource/memory-constraints-pod.yaml --namespace=constraints-mem-example

确认下 Pod 中的容器在运行:

kubectl get pod constraints-mem-demo --namespace=constraints-mem-example

查看 Pod 详情:

kubectl get pod constraints-mem-demo --output=yaml --namespace=constraints-mem-example

输出结果显示容器的内存请求为600 MiB,内存限制为800 MiB。这些满足了 LimitRange 设定的限制范围。

resources:

limits:

memory: 800Mi

requests:

memory: 600Mi

删除你创建的 Pod:

kubectl delete pod constraints-mem-demo --namespace=constraints-mem-example

这里给出了包含一个容器的 Pod 的配置文件。容器声明了800 MiB 的内存请求和1.5 GiB 的内存限制。

apiVersion: v1

kind: Pod

metadata:

name: constraints-mem-demo-2

spec:

containers:

- name: constraints-mem-demo-2-ctr

image: nginx

resources:

limits:

memory: "1.5Gi"

requests:

memory: "800Mi"

尝试创建 Pod:

kubectl apply -f https://k8s.io/examples/admin/resource/memory-constraints-pod-2.yaml --namespace=constraints-mem-example

输出结果显示 Pod 没有创建成功,因为容器声明的内存限制太大了:

Error from server (Forbidden): error when creating "examples/admin/resource/memory-constraints-pod-2.yaml":

pods "constraints-mem-demo-2" is forbidden: maximum memory usage per Container is 1Gi, but limit is 1536Mi.

这里给出了包含一个容器的 Pod 的配置文件。容器声明了100 MiB 的内存请求和800 MiB 的内存限制。

apiVersion: v1

kind: Pod

metadata:

name: constraints-mem-demo-3

spec:

containers:

- name: constraints-mem-demo-3-ctr

image: nginx

resources:

limits:

memory: "800Mi"

requests:

memory: "100Mi"

尝试创建 Pod:

kubectl apply -f https://k8s.io/examples/admin/resource/memory-constraints-pod-3.yaml --namespace=constraints-mem-example

输出结果显示 Pod 没有创建成功,因为容器声明的内存请求太小了:

Error from server (Forbidden): error when creating "examples/admin/resource/memory-constraints-pod-3.yaml":

pods "constraints-mem-demo-3" is forbidden: minimum memory usage per Container is 500Mi, but request is 100Mi.

这里给出了包含一个容器的 Pod 的配置文件。容器没有声明内存请求,也没有声明内存限制。

apiVersion: v1

kind: Pod

metadata:

name: constraints-mem-demo-4

spec:

containers:

- name: constraints-mem-demo-4-ctr

image: nginx

创建 Pod:

kubectl apply -f https://k8s.io/examples/admin/resource/memory-constraints-pod-4.yaml --namespace=constraints-mem-example

查看 Pod 详情:

kubectl get pod constraints-mem-demo-4 --namespace=constraints-mem-example --output=yaml

输出结果显示 Pod 的内存请求为1 GiB,内存限制为1 GiB。容器怎样获得哪些数值呢?

resources:

limits:

memory: 1Gi

requests:

memory: 1Gi

因为你的容器没有声明自己的内存请求和限制,它从 LimitRange 那里获得了 默认的内存请求和限制。

此时,你的容器可能运行起来也可能没有运行起来。 回想一下我们本次任务的先决条件是你的每个节点都至少有1 GiB 的内存。 如果你的每个节点都只有1 GiB 的内存,那将没有一个节点拥有足够的可分配内存来满足1 GiB 的内存请求。

删除你的 Pod:

kubectl delete pod constraints-mem-demo-4 --namespace=constraints-mem-example

LimitRange 为命名空间设定的最小和最大内存限制只有在 Pod 创建和更新时才会强制执行。 如果你更新 LimitRange,它不会影响此前创建的 Pod。

作为集群管理员,你可能想规定 Pod 可以使用的内存总量限制。例如:

删除你的命名空间:

kubectl delete namespace constraints-mem-example

本页介绍如何为命名空间中容器和 Pod 使用的 CPU 资源设置最小和最大值。 你可以通过 LimitRange 对象声明 CPU 的最小和最大值. 如果 Pod 不能满足 LimitRange 的限制,它就不能在命名空间中创建。

你必须拥有一个 Kubernetes 的集群,同时你的 Kubernetes 集群必须带有 kubectl 命令行工具。 建议在至少有两个节点的集群上运行本教程,且这些节点不作为控制平面主机。 如果你还没有集群,你可以通过 Minikube 构建一个你自己的集群,或者你可以使用下面任意一个 Kubernetes 工具构建:

要获知版本信息,请输入kubectl version.

你的集群中每个节点至少要有 1 个 CPU 可用才能运行本任务示例。

创建一个命名空间,以便本练习中创建的资源和集群的其余资源相隔离。

kubectl create namespace constraints-cpu-example

这里给出了 LimitRange 的配置文件:

apiVersion: v1

kind: LimitRange

metadata:

name: cpu-min-max-demo-lr

spec:

limits:

- max:

cpu: "800m"

min:

cpu: "200m"

type: Container

创建 LimitRange:

kubectl apply -f https://k8s.io/examples/admin/resource/cpu-constraints.yaml --namespace=constraints-cpu-example

查看 LimitRange 详情:

kubectl get limitrange cpu-min-max-demo-lr --output=yaml --namespace=constraints-cpu-example

输出结果显示 CPU 的最小和最大限制符合预期。但需要注意的是,尽管你在 LimitRange 的配置文件中你没有声明默认值,默认值也会被自动创建。

limits:

- default:

cpu: 800m

defaultRequest:

cpu: 800m

max:

cpu: 800m

min:

cpu: 200m

type: Container

现在不管什么时候在 constraints-cpu-example 命名空间中创建容器,Kubernetes 都会执行下面这些步骤:

如果容器没有声明自己的 CPU 请求和限制,将为容器指定默认 CPU 请求和限制。

核查容器声明的 CPU 请求确保其大于或者等于 200 millicpu。

核查容器声明的 CPU 限制确保其小于或者等于 800 millicpu。

这里给出了包含一个容器的 Pod 的配置文件。 该容器声明了 500 millicpu 的 CPU 请求和 800 millicpu 的 CPU 限制。 这些参数满足了 LimitRange 对象规定的 CPU 最小和最大限制。

apiVersion: v1

kind: Pod

metadata:

name: constraints-cpu-demo

spec:

containers:

- name: constraints-cpu-demo-ctr

image: nginx

resources:

limits:

cpu: "800m"

requests:

cpu: "500m"

创建Pod:

kubectl apply -f https://k8s.io/examples/admin/resource/cpu-constraints-pod.yaml --namespace=constraints-cpu-example

确认一下 Pod 中的容器在运行:

kubectl get pod constraints-cpu-demo --namespace=constraints-cpu-example

查看 Pod 的详情:

kubectl get pod constraints-cpu-demo --output=yaml --namespace=constraints-cpu-example

输出结果表明容器的 CPU 请求为 500 millicpu,CPU 限制为 800 millicpu。 这些参数满足 LimitRange 规定的限制范围。

resources:

limits:

cpu: 800m

requests:

cpu: 500m

kubectl delete pod constraints-cpu-demo --namespace=constraints-cpu-example

这里给出了包含一个容器的 Pod 的配置文件。容器声明了 500 millicpu 的 CPU 请求和 1.5 CPU 的 CPU 限制。

apiVersion: v1

kind: Pod

metadata:

name: constraints-cpu-demo-2

spec:

containers:

- name: constraints-cpu-demo-2-ctr

image: nginx

resources:

limits:

cpu: "1.5"

requests:

cpu: "500m"

尝试创建 Pod:

kubectl apply -f https://k8s.io/examples/admin/resource/cpu-constraints-pod-2.yaml --namespace=constraints-cpu-example

输出结果表明 Pod 没有创建成功,因为容器声明的 CPU 限制太大了:

Error from server (Forbidden): error when creating "examples/admin/resource/cpu-constraints-pod-2.yaml":

pods "constraints-cpu-demo-2" is forbidden: maximum cpu usage per Container is 800m, but limit is 1500m.

这里给出了包含一个容器的 Pod 的配置文件。该容器声明了100 millicpu的 CPU 请求和800 millicpu的 CPU 限制。

apiVersion: v1

kind: Pod

metadata:

name: constraints-cpu-demo-3

spec:

containers:

- name: constraints-cpu-demo-3-ctr

image: nginx

resources:

limits:

cpu: "800m"

requests:

cpu: "100m"

尝试创建 Pod:

kubectl apply -f https://k8s.io/examples/admin/resource/cpu-constraints-pod-3.yaml --namespace=constraints-cpu-example

输出结果显示 Pod 没有创建成功,因为容器声明的 CPU 请求太小了:

Error from server (Forbidden): error when creating "examples/admin/resource/cpu-constraints-pod-3.yaml":

pods "constraints-cpu-demo-4" is forbidden: minimum cpu usage per Container is 200m, but request is 100m.

这里给出了包含一个容器的 Pod 的配置文件。该容器没有设定 CPU 请求和 CPU 限制。

apiVersion: v1

kind: Pod

metadata:

name: constraints-cpu-demo-4

spec:

containers:

- name: constraints-cpu-demo-4-ctr

image: vish/stress

创建 Pod:

kubectl apply -f https://k8s.io/examples/admin/resource/cpu-constraints-pod-4.yaml --namespace=constraints-cpu-example

查看 Pod 的详情:

kubectl get pod constraints-cpu-demo-4 --namespace=constraints-cpu-example --output=yaml

输出结果显示 Pod 的容器有个 800 millicpu 的 CPU 请求和 800 millicpu 的 CPU 限制。 容器是怎样得到那些值的呢?

resources:

limits:

cpu: 800m

requests:

cpu: 800m

因为你的 Container 没有声明自己的 CPU 请求和限制,LimitRange 给它指定了 默认的 CPU 请求和限制

此时,你的容器可能运行也可能没有运行。 回想一下,本任务的先决条件是你的节点要有 1 个 CPU。 如果你的每个节点仅有 1 个 CPU,那么可能没有任何一个节点可以满足 800 millicpu 的 CPU 请求。 如果你在用的节点恰好有两个 CPU,那么你才可能有足够的 CPU 来满足 800 millicpu 的请求。

kubectl delete pod constraints-cpu-demo-4 --namespace=constraints-cpu-example

只有当 Pod 创建或者更新时,LimitRange 为命名空间规定的 CPU 最小和最大限制才会被强制执行。 如果你对 LimitRange 进行修改,那不会影响此前创建的 Pod。

作为集群管理员,你可能想设定 Pod 可以使用的 CPU 资源限制。例如:

删除你的命名空间:

kubectl delete namespace constraints-cpu-example

本文介绍怎样为命名空间设置容器可用的内存和 CPU 总量。你可以通过 ResourceQuota 对象设置配额.

你必须拥有一个 Kubernetes 的集群,同时你的 Kubernetes 集群必须带有 kubectl 命令行工具。 建议在至少有两个节点的集群上运行本教程,且这些节点不作为控制平面主机。 如果你还没有集群,你可以通过 Minikube 构建一个你自己的集群,或者你可以使用下面任意一个 Kubernetes 工具构建:

要获知版本信息,请输入kubectl version.

集群中每个节点至少有 1 GiB 的内存。

创建一个命名空间,以便本练习中创建的资源和集群的其余部分相隔离。

kubectl create namespace quota-mem-cpu-example

这里给出一个 ResourceQuota 对象的配置文件:

apiVersion: v1

kind: ResourceQuota

metadata:

name: mem-cpu-demo

spec:

hard:

requests.cpu: "1"

requests.memory: 1Gi

limits.cpu: "2"

limits.memory: 2Gi

创建 ResourceQuota

kubectl apply -f https://k8s.io/examples/admin/resource/quota-mem-cpu.yaml --namespace=quota-mem-cpu-example

查看 ResourceQuota 详情:

kubectl get resourcequota mem-cpu-demo --namespace=quota-mem-cpu-example --output=yaml

ResourceQuota 在 quota-mem-cpu-example 命名空间中设置了如下要求:

这里给出 Pod 的配置文件:

apiVersion: v1

kind: Pod

metadata:

name: quota-mem-cpu-demo

spec:

containers:

- name: quota-mem-cpu-demo-ctr

image: nginx

resources:

limits:

memory: "800Mi"

cpu: "800m"

requests:

memory: "600Mi"

cpu: "400m"

创建 Pod:

kubectl apply -f https://k8s.io/examples/admin/resource/quota-mem-cpu-pod.yaml --namespace=quota-mem-cpu-example

检查下 Pod 中的容器在运行:

kubectl get pod quota-mem-cpu-demo --namespace=quota-mem-cpu-example

再查看 ResourceQuota 的详情:

kubectl get resourcequota mem-cpu-demo --namespace=quota-mem-cpu-example --output=yaml

输出结果显示了配额以及有多少配额已经被使用。你可以看到 Pod 的内存和 CPU 请求值及限制值没有超过配额。

status:

hard:

limits.cpu: "2"

limits.memory: 2Gi

requests.cpu: "1"

requests.memory: 1Gi

used:

limits.cpu: 800m

limits.memory: 800Mi

requests.cpu: 400m

requests.memory: 600Mi

这里给出了第二个 Pod 的配置文件:

apiVersion: v1

kind: Pod

metadata:

name: quota-mem-cpu-demo-2

spec:

containers:

- name: quota-mem-cpu-demo-2-ctr

image: redis

resources:

limits:

memory: "1Gi"

cpu: "800m"

requests:

memory: "700Mi"

cpu: "400m"

配置文件中,你可以看到 Pod 的内存请求为 700 MiB。 请注意新的内存请求与已经使用的内存请求只和超过了内存请求的配额。 600 MiB + 700 MiB > 1 GiB。

尝试创建 Pod:

kubectl apply -f https://k8s.io/examples/admin/resource/quota-mem-cpu-pod-2.yaml --namespace=quota-mem-cpu-example

第二个 Pod 不能被创建成功。输出结果显示创建第二个 Pod 会导致内存请求总量超过内存请求配额。

Error from server (Forbidden): error when creating "examples/admin/resource/quota-mem-cpu-pod-2.yaml":

pods "quota-mem-cpu-demo-2" is forbidden: exceeded quota: mem-cpu-demo,

requested: requests.memory=700Mi,used: requests.memory=600Mi, limited: requests.memory=1Gi

如你在本练习中所见,你可以用 ResourceQuota 限制命名空间中所有容器的内存请求总量。 同样你也可以限制内存限制总量、CPU 请求总量、CPU 限制总量。

如果你想对单个容器而不是所有容器进行限制,就请使用 LimitRange。

删除你的命名空间:

kubectl delete namespace quota-mem-cpu-example

本文主要描述如何配置一个命名空间下可运行的 Pod 个数配额。 你可以使用 ResourceQuota 对象来配置配额。

你必须拥有一个 Kubernetes 的集群,同时你的 Kubernetes 集群必须带有 kubectl 命令行工具。 建议在至少有两个节点的集群上运行本教程,且这些节点不作为控制平面主机。 如果你还没有集群,你可以通过 Minikube 构建一个你自己的集群,或者你可以使用下面任意一个 Kubernetes 工具构建:

要获知版本信息,请输入kubectl version.

首先创建一个命名空间,这样可以将本次操作中创建的资源与集群其他资源隔离开来。

kubectl create namespace quota-pod-example

下面是一个 ResourceQuota 的配置文件:

apiVersion: v1

kind: ResourceQuota

metadata:

name: pod-demo

spec:

hard:

pods: "2"

创建这个 ResourceQuota:

kubectl apply -f https://k8s.io/examples/admin/resource/quota-pod.yaml --namespace=quota-pod-example

查看资源配额的详细信息:

kubectl get resourcequota pod-demo --namespace=quota-pod-example --output=yaml

从输出的信息我们可以看到,该命名空间下 Pod 的配额是 2 个,目前创建的 Pod 数为 0, 配额使用率为 0。

spec:

hard:

pods: "2"

status:

hard:

pods: "2"

used:

pods: "0"

下面是一个 Deployment 的配置文件:

apiVersion: apps/v1

kind: Deployment

metadata:

name: pod-quota-demo

spec:

selector:

matchLabels:

purpose: quota-demo

replicas: 3

template:

metadata:

labels:

purpose: quota-demo

spec:

containers:

- name: pod-quota-demo

image: nginx

在配置文件中,replicas: 3 告诉 Kubernetes 尝试创建三个 Pods,且运行相同的应用。

创建这个 Deployment:

kubectl apply -f https://k8s.io/examples/admin/resource/quota-pod-deployment.yaml --namespace=quota-pod-example

查看 Deployment 的详细信息:

kubectl get deployment pod-quota-demo --namespace=quota-pod-example --output=yaml

从输出的信息我们可以看到,尽管尝试创建三个 Pod,但是由于配额的限制,只有两个 Pod 能被成功创建。

spec:

...

replicas: 3

...

status:

availableReplicas: 2

...

lastUpdateTime: 2017-07-07T20:57:05Z

message: 'unable to create pods: pods "pod-quota-demo-1650323038-" is forbidden:

exceeded quota: pod-demo, requested: pods=1, used: pods=2, limited: pods=2'

删除命名空间:

kubectl delete namespace quota-pod-example

在使用客户端证书认证的场景下,你可以通过 easyrsa、openssl 或 cfssl 等工具以手工方式生成证书。

easyrsa 支持以手工方式为你的集群生成证书。

下载、解压、初始化打过补丁的 easyrsa3。

curl -LO https://storage.googleapis.com/kubernetes-release/easy-rsa/easy-rsa.tar.gz

tar xzf easy-rsa.tar.gz

cd easy-rsa-master/easyrsa3

./easyrsa init-pki

生成新的证书颁发机构(CA)。参数 --batch 用于设置自动模式;

参数 --req-cn 用于设置新的根证书的通用名称(CN)。

./easyrsa --batch "--req-cn=${MASTER_IP}@`date +%s`" build-ca nopass

生成服务器证书和秘钥。

参数 --subject-alt-name 设置 API 服务器的 IP 和 DNS 名称。

MASTER_CLUSTER_IP 用于 API 服务器和控制管理器,通常取 CIDR 的第一个 IP,由 --service-cluster-ip-range 的参数提供。

参数 --days 用于设置证书的过期时间。

下面的示例假定你的默认 DNS 域名为 cluster.local。

./easyrsa --subject-alt-name="IP:${MASTER_IP},"\

"IP:${MASTER_CLUSTER_IP},"\

"DNS:kubernetes,"\

"DNS:kubernetes.default,"\

"DNS:kubernetes.default.svc,"\

"DNS:kubernetes.default.svc.cluster,"\

"DNS:kubernetes.default.svc.cluster.local" \

--days=10000 \

build-server-full server nopass

拷贝文件 pki/ca.crt、pki/issued/server.crt 和 pki/private/server.key 到你的目录中。

在 API 服务器的启动参数中添加以下参数:

--client-ca-file=/yourdirectory/ca.crt

--tls-cert-file=/yourdirectory/server.crt

--tls-private-key-file=/yourdirectory/server.key

openssl 支持以手工方式为你的集群生成证书。

生成一个 2048 位的 ca.key 文件

openssl genrsa -out ca.key 2048

在 ca.key 文件的基础上,生成 ca.crt 文件(用参数 -days 设置证书有效期)

openssl req -x509 -new -nodes -key ca.key -subj "/CN=${MASTER_IP}" -days 10000 -out ca.crt

生成一个 2048 位的 server.key 文件:

openssl genrsa -out server.key 2048

创建一个用于生成证书签名请求(CSR)的配置文件。

保存文件(例如:csr.conf)前,记得用真实值替换掉尖括号中的值(例如:<MASTER_IP>)。

注意:MASTER_CLUSTER_IP 就像前一小节所述,它的值是 API 服务器的服务集群 IP。

下面的例子假定你的默认 DNS 域名为 cluster.local。

[ req ]

default_bits = 2048

prompt = no

default_md = sha256

req_extensions = req_ext

distinguished_name = dn

[ dn ]

C = <country>

ST = <state>

L = <city>

O = <organization>

OU = <organization unit>

CN = <MASTER_IP>

[ req_ext ]

subjectAltName = @alt_names

[ alt_names ]

DNS.1 = kubernetes

DNS.2 = kubernetes.default

DNS.3 = kubernetes.default.svc

DNS.4 = kubernetes.default.svc.cluster

DNS.5 = kubernetes.default.svc.cluster.local

IP.1 = <MASTER_IP>

IP.2 = <MASTER_CLUSTER_IP>

[ v3_ext ]

authorityKeyIdentifier=keyid,issuer:always

basicConstraints=CA:FALSE

keyUsage=keyEncipherment,dataEncipherment

extendedKeyUsage=serverAuth,clientAuth

subjectAltName=@alt_names

基于上面的配置文件生成证书签名请求:

openssl req -new -key server.key -out server.csr -config csr.conf

基于 ca.key、ca.crt 和 server.csr 等三个文件生成服务端证书:

openssl x509 -req -in server.csr -CA ca.crt -CAkey ca.key \

-CAcreateserial -out server.crt -days 10000 \

-extensions v3_ext -extfile csr.conf

查看证书签名请求:

openssl req -noout -text -in ./server.csr

查看证书:

openssl x509 -noout -text -in ./server.crt

最后,为 API 服务器添加相同的启动参数。

cfssl 是另一个用于生成证书的工具。

下载、解压并准备如下所示的命令行工具。 注意:你可能需要根据所用的硬件体系架构和 cfssl 版本调整示例命令。

curl -L https://github.com/cloudflare/cfssl/releases/download/v1.5.0/cfssl_1.5.0_linux_amd64 -o cfssl

chmod +x cfssl

curl -L https://github.com/cloudflare/cfssl/releases/download/v1.5.0/cfssljson_1.5.0_linux_amd64 -o cfssljson

chmod +x cfssljson

curl -L https://github.com/cloudflare/cfssl/releases/download/v1.5.0/cfssl-certinfo_1.5.0_linux_amd64 -o cfssl-certinfo

chmod +x cfssl-certinfo

创建一个目录,用它保存所生成的构件和初始化 cfssl:

mkdir cert

cd cert

../cfssl print-defaults config > config.json

../cfssl print-defaults csr > csr.json

创建一个 JSON 配置文件来生成 CA 文件,例如:ca-config.json:

{

"signing": {

"default": {

"expiry": "8760h"

},

"profiles": {

"kubernetes": {

"usages": [

"signing",

"key encipherment",

"server auth",

"client auth"

],

"expiry": "8760h"

}

}

}

}

创建一个 JSON 配置文件,用于 CA 证书签名请求(CSR),例如:ca-csr.json。

确认用你需要的值替换掉尖括号中的值。

{

"CN": "kubernetes",

"key": {

"algo": "rsa",

"size": 2048

},

"names":[{

"C": "<country>",

"ST": "<state>",

"L": "<city>",

"O": "<organization>",

"OU": "<organization unit>"

}]

}

生成 CA 秘钥文件(ca-key.pem)和证书文件(ca.pem):

../cfssl gencert -initca ca-csr.json | ../cfssljson -bare ca

创建一个 JSON 配置文件,用来为 API 服务器生成秘钥和证书,例如:server-csr.json。

确认用你需要的值替换掉尖括号中的值。MASTER_CLUSTER_IP 是为 API 服务器 指定的服务集群 IP,就像前面小节描述的那样。

以下示例假定你的默认 DSN 域名为cluster.local。

{

"CN": "kubernetes",

"hosts": [

"127.0.0.1",

"<MASTER_IP>",

"<MASTER_CLUSTER_IP>",

"kubernetes",

"kubernetes.default",

"kubernetes.default.svc",

"kubernetes.default.svc.cluster",

"kubernetes.default.svc.cluster.local"

],

"key": {

"algo": "rsa",

"size": 2048

},

"names": [{

"C": "<country>",

"ST": "<state>",

"L": "<city>",

"O": "<organization>",

"OU": "<organization unit>"

}]

}

为 API 服务器生成秘钥和证书,默认会分别存储为server-key.pem 和 server.pem 两个文件。

../cfssl gencert -ca=ca.pem -ca-key=ca-key.pem \

--config=ca-config.json -profile=kubernetes \

server-csr.json | ../cfssljson -bare server

客户端节点可能不认可自签名 CA 证书的有效性。 对于非生产环境,或者运行在公司防火墙后的环境,你可以分发自签名的 CA 证书到所有客户节点,并刷新本地列表以使证书生效。

在每一个客户节点,执行以下操作:

sudo cp ca.crt /usr/local/share/ca-certificates/kubernetes.crt

sudo update-ca-certificates

Updating certificates in /etc/ssl/certs...

1 added, 0 removed; done.

Running hooks in /etc/ca-certificates/update.d....

done.

你可以通过 certificates.k8s.io API 提供 x509 证书,用来做身份验证,

如本文档所述。

本页展示了如何在 kubernetes 中安装和使用 Antrea CNI 插件。 要了解 Antrea 项目的背景,请阅读 Antrea 介绍。

你需要拥有一个 kuernetes 集群。 遵循 kubeadm 入门指南自行创建一个。

遵循入门指南 为 kubeadm 部署 Antrea 。

一旦你的集群已经运行,你可以遵循 声明网络策略 来尝试 Kubernetes NetworkPolicy。

本页展示了几种在 Kubernetes 上快速创建 Calico 集群的方法。

先决条件: gcloud

启动一个带有 Calico 的 GKE 集群,需要加上参数 --enable-network-policy。

语法

gcloud container clusters create [CLUSTER_NAME] --enable-network-policy

示例

gcloud container clusters create my-calico-cluster --enable-network-policy

使用如下命令验证部署是否正确。

kubectl get pods --namespace=kube-system

Calico 的 pods 名以 calico 打头,检查确认每个 pods 状态为 Running。

使用 kubeadm 在 15 分钟内得到一个本地单主机 Calico 集群,请参考 Calico 快速入门。

集群运行后,您可以按照声明网络策略 去尝试使用 Kubernetes NetworkPolicy。

本页展示如何使用 Cilium 提供 NetworkPolicy。

关于 Cilium 的背景知识,请阅读 Cilium 介绍。

你必须拥有一个 Kubernetes 的集群,同时你的 Kubernetes 集群必须带有 kubectl 命令行工具。 建议在至少有两个节点的集群上运行本教程,且这些节点不作为控制平面主机。 如果你还没有集群,你可以通过 Minikube 构建一个你自己的集群,或者你可以使用下面任意一个 Kubernetes 工具构建:

要获知版本信息,请输入kubectl version.

为了轻松熟悉 Cilium 你可以根据 Cilium Kubernetes 入门指南 在 minikube 中执行一个 cilium 的基本 DaemonSet 安装。

要启动 minikube,需要的最低版本为 1.5.2,使用下面的参数运行:

minikube version

minikube version: v1.5.2

minikube start --network-plugin=cni --memory=4096

对于 minikube 你可以使用 Cilium 的 CLI 工具安装它。 Cilium 将自动检测集群配置并为成功的集群部署选择合适的组件。

curl -LO https://github.com/cilium/cilium-cli/releases/latest/download/cilium-linux-amd64.tar.gz

sudo tar xzvfC cilium-linux-amd64.tar.gz /usr/local/bin

rm cilium-linux-amd64.tar.gz

cilium install

🔮 Auto-detected Kubernetes kind: minikube

✨ Running "minikube" validation checks

✅ Detected minikube version "1.20.0"

ℹ️ Cilium version not set, using default version "v1.10.0"

🔮 Auto-detected cluster name: minikube

🔮 Auto-detected IPAM mode: cluster-pool

🔮 Auto-detected datapath mode: tunnel

🔑 Generating CA...

2021/05/27 02:54:44 [INFO] generate received request

2021/05/27 02:54:44 [INFO] received CSR

2021/05/27 02:54:44 [INFO] generating key: ecdsa-256

2021/05/27 02:54:44 [INFO] encoded CSR

2021/05/27 02:54:44 [INFO] signed certificate with serial number 48713764918856674401136471229482703021230538642

🔑 Generating certificates for Hubble...

2021/05/27 02:54:44 [INFO] generate received request

2021/05/27 02:54:44 [INFO] received CSR

2021/05/27 02:54:44 [INFO] generating key: ecdsa-256

2021/05/27 02:54:44 [INFO] encoded CSR

2021/05/27 02:54:44 [INFO] signed certificate with serial number 3514109734025784310086389188421560613333279574

🚀 Creating Service accounts...

🚀 Creating Cluster roles...